-

Compteur de contenus

29 915 -

Inscription

-

Dernière visite

-

Jours gagnés

1 141

Type de contenu

Profils

Forums

Calendrier

Tout ce qui a été posté par Ldfa

-

Le morceau original !!!

-

Je suis devenu accro à ce jeu et j'y passe énormément de temps, mais quel plaisir ! Les devs ont ajouté une guitare dernièrement dans Arc Raiders, c'est vraiment très cool de jouer un petit morceau en fin de partie avec les autres Raiders avant de s'extraire.

-

Linux ZimaOS : le grand frère de CasaOS pour serveurs et NAS DIY - Up and Clear | Reborn

Ldfa a répondu à un(e) sujet de Ldfa dans Mon Wallabag

Pour installer ZimaOS sur Proxmox : https://github.com/R0GGER/proxmox-zimaos -

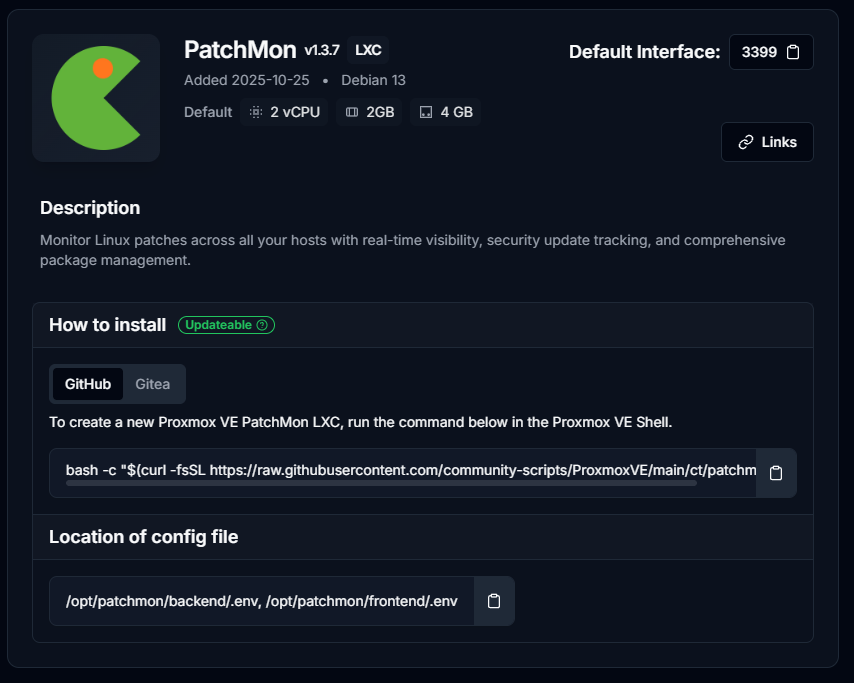

Linux PatchMon : surveillez les mises à jour des machines Linux - IT Connect

Ldfa a répondu à un(e) sujet de Ldfa dans Mon Wallabag

Pour installer Patchmon sur Proxmox : https://community-scripts.github.io/ProxmoxVE/scripts?id=patchmon -

Linux PatchMon : surveillez les mises à jour des machines Linux - IT Connect

Ldfa a posté un sujet dans Mon Wallabag

IT-Connect Publié le 12 janvier 2026 Par Florian BURNEL it-connect.fr Environ 12 minutes de lecture PatchMon est une solution open source de Patch Monitoring pour les serveurs Linux, qu'ils soient sous Debian, Ubuntu, Alma Linux ou encore Red Hat Enterprise Linux (RHEL). L'objectif principal de PatchMon est le suivant : vous offrir une vue d'ensemble sur l'état des mises à jour sur vos machines Linux. Ainsi, vous pouvez identifier facilement les machines sur lesquelles des mises à jour de paquets sont en attente, avec une mise en évidence des mises à jour de sécurité. Les machines sous Linux, au même titre que celles sous Windows, reçoivent des mises à jour. D'une part, il y a les mises à jour du système et du noyau, et d'autre part, les mises à jour des paquets installés (du paquet de la simple bibliothèque à celui d'un service utilisé en production). Comment suivre la disponibilité des mises à jour ? Si l'on prend l'exemple de machines sous Debian, exécuter les commandes apt update et apt upgrade manuellement n'est pas une solution viable et efficace. C'est là qu'un outil comme PatchMon apporte une valeur ajoutée : son tableau de bord affiche l'état des mises à jour de l'ensemble de vos machines Linux. Son fonctionnement repose sur l'installation d'un agent sur les machines à monitorer. À la clé : Un inventaire de vos machines (avec la répartition par type d'OS) Un aperçu du niveau de mises à jour de vos machines (à jour, en attente de mise à jour, en attente d'un redémarrage) Une visibilité sur le type de mises à jour en attente (distinction entre mise à jour standard et correctif de sécurité) Une tendance globale dans le temps Des statistiques globales sur l'ensemble de votre SI L'état de la réception des données de la part des agents Au-delà d'offrir une vue par machine, PatchMon offre aussi une vue par paquet : pratique pour identifier les machines sur lesquelles est installé tel ou tel paquet. Il référence aussi la liste des dépôts (repos) configurés sur vos machines. Précision importante : la version actuelle de PatchMon ne permet pas de gérer la mise à jour des paquets. Nous sommes donc dans une approche de monitoring, sans qu'il soit possible d'appliquer les mises à jour en attente. Mais les choses vont évoluer à l'avenir : la feuille de route évoque des fonctionnalités croustillantes, dont celle-ci. PatchMon est un projet qui a énormément progressé en quelques mois. L'intégration avec Docker pour remonter les informations sur les conteneurs, les images, etc... est actuellement en bêta, tandis que d'autres intégrations sont en préparation (Proxmox VE, etc.). C'est un projet à suivre en 2026 ! GitHub - PatchMon Installation du serveur PatchMon L'installation de PatchMon sera réalisée sur un serveur où Docker a été installé au préalable. Nous utiliserons un fichier Docker Compose car la stack PatchMon repose sur plusieurs conteneurs : Base de données avec PostgreSQL, Cache objet avec Redis, Backend de PatchMon, Frontend de PatchMon Créer un dossier pour le projet Docker Comme à mon habitude, j'ai créé un dossier dédié à ce projet sur mon serveur afin d'isoler les données associées à PatchMon. Le dossier suivant a été créé : /opt/docker-compose/patchmon Par la suite, trois sous-dossiers seront créés dans ce dossier (vous pouvez les créer manuellement ou laisser Docker procéder) : /opt/docker-compose/patchmon | |___ agent_files |___ postgres_data |___ redis_data Note : un quatrième dossier nommé branding_assets peut être ajouté si vous souhaitez déposer des éléments spécifiques pour personnaliser l'apparence de l'interface. Par exemple : remplacer le logo PatchMon par celui de votre entreprise. Générer 3 mots de passe Avant de créer le fichier Docker Compose, je vous invite à générer trois mots de passe qu'il sera nécessaire d'insérer dans ce fichier. Ils seront utilisés pour personnaliser les mots de passe de PostgreSQL et Redis, et pour le secret JWT. Voici à titre d'information les trois valeurs utilisées pour ce tutoriel et obtenues via la même commande que vous pouvez lancer sur votre serveur. # Mot de passe de la base de données openssl rand -hex 64 eb2b687f514ddcd25226de40437a59a0f9fbac5ffe72fda2e5e6d11b31e2b9e99c4aeb6944f73c37f76ba175082821a69fb625d1b080dac7df66a7ff1ea967af # Mot de passe Redis openssl rand -hex 64 0ba2b3084b93fa7bfb49452c23bea7a50c2772a9c1e3e83437db283ea37874e59febd0e09d77e1579348d2fb10cf46e7a7de17656bc7312099622fada8f42f23 # Secret JWT openssl rand -hex 64 e0b7f1ad9bd73bd271b3d161fb013c6a90e5de48e8ed4b0cb80d9717f4cb1886470671f527565158c37a1c78db92614287844eb95135abaee50ac60a0539a2cb Créer le fichier Docker Compose Voici le fichier docker-compose.yml que vous devez créer à la racine de votre projet PatchMon. Vous devez le personnaliser de façon à insérer vos mots de passe. J'ai mis des couleurs distinctes sur les trois valeurs pour que vous puissiez vous y retrouver. Cette configuration s'appuie sur la version disponible sur le GitHub officiel du projet. name: patchmon services: database: image: postgres:17-alpine restart: unless-stopped environment: POSTGRES_DB: patchmon_db POSTGRES_USER: patchmon_user POSTGRES_PASSWORD: eb2b687f514ddcd25226de40437a59a0f9fbac5ffe72fda2e5e6d11b31e2b9e99c4aeb6944f73c37f76ba175082821a69fb625d1b080dac7df66a7ff1ea967af volumes: - ./postgres_data:/var/lib/postgresql/data networks: - patchmon-internal healthcheck: test: ["CMD-SHELL", "pg_isready -U patchmon_user -d patchmon_db"] interval: 3s timeout: 5s retries: 7 redis: image: redis:7-alpine restart: unless-stopped command: redis-server --requirepass 0ba2b3084b93fa7bfb49452c23bea7a50c2772a9c1e3e83437db283ea37874e59febd0e09d77e1579348d2fb10cf46e7a7de17656bc7312099622fada8f42f23 volumes: - ./redis_data:/data networks: - patchmon-internal healthcheck: test: ["CMD", "redis-cli", "--no-auth-warning", "-a", "0ba2b3084b93fa7bfb49452c23bea7a50c2772a9c1e3e83437db283ea37874e59febd0e09d77e1579348d2fb10cf46e7a7de17656bc7312099622fada8f42f23", "ping"] interval: 3s timeout: 5s retries: 7 backend: image: ghcr.io/patchmon/patchmon-backend:latest restart: unless-stopped # See PatchMon Docker README for additional environment variables and configuration instructions environment: LOG_LEVEL: info DATABASE_URL: postgresql://patchmon_user:eb2b687f514ddcd25226de40437a59a0f9fbac5ffe72fda2e5e6d11b31e2b9e99c4aeb6944f73c37f76ba175082821a69fb625d1b080dac7df66a7ff1ea967af@database:5432/patchmon_db JWT_SECRET: e0b7f1ad9bd73bd271b3d161fb013c6a90e5de48e8ed4b0cb80d9717f4cb1886470671f527565158c37a1c78db92614287844eb95135abaee50ac60a0539a2cb SERVER_PROTOCOL: http SERVER_HOST: 192.168.10.200 SERVER_PORT: 3000 CORS_ORIGIN: http://192.168.10.200:3000 # Database Connection Pool Configuration (Prisma) DB_CONNECTION_LIMIT: 30 DB_POOL_TIMEOUT: 20 DB_CONNECT_TIMEOUT: 10 DB_IDLE_TIMEOUT: 300 DB_MAX_LIFETIME: 1800 # Rate Limiting (times in milliseconds) RATE_LIMIT_WINDOW_MS: 900000 RATE_LIMIT_MAX: 5000 AUTH_RATE_LIMIT_WINDOW_MS: 600000 AUTH_RATE_LIMIT_MAX: 500 AGENT_RATE_LIMIT_WINDOW_MS: 60000 AGENT_RATE_LIMIT_MAX: 1000 # Redis Configuration REDIS_HOST: redis REDIS_PORT: 6379 REDIS_PASSWORD: 0ba2b3084b93fa7bfb49452c23bea7a50c2772a9c1e3e83437db283ea37874e59febd0e09d77e1579348d2fb10cf46e7a7de17656bc7312099622fada8f42f23 REDIS_DB: 0 volumes: - ./agent_files:/app/agents networks: - patchmon-internal depends_on: database: condition: service_healthy redis: condition: service_healthy frontend: image: ghcr.io/patchmon/patchmon-frontend:latest restart: unless-stopped ports: - "3000:3000" networks: - patchmon-internal depends_on: backend: condition: service_healthy volumes: postgres_data: redis_data: agent_files: networks: patchmon-internal: driver: bridge Dans ce fichier, vous pourrez constater que : Les conteneurs seront connectés sur le même réseau Docker intitulé patchmon-internal, L'application est exposée sur le port 3000 via le conteneur frontend, Des dépendances sont définies entre certains conteneurs via les instructions depends_on. Au-delà des mots de passe et secrets, vous devez ajuster plusieurs variables pour éviter d'avoir une erreur de sécurité lors de la première connexion : SERVER_PROTOCOL: http : http ou https, selon la méthode d'accès. SERVER_HOST: 192.168.10.200 : le nom public du serveur, mettez l'IP ou le nom. SERVER_PORT: 3000 : le port d'accès, doit être cohérent vis-à-vis du port exposé sur le frontend. CORS_ORIGIN: http://192.168.10.200:3000 : ajustez cette valeur pour qu'elle représente l'adresse publique sur laquelle sera joignable PatchMon. Autrement dit, n'indiquez pas localhost ou 127.0.0.1. Ici, je précise l'adresse IP de mon hôte Docker car les échanges seront uniquement sur le réseau local. Ici, nous effectuons un accès en HTTP à l'application PatchMon. Pour la production, il est bien entendu recommandé d'associer un reverse proxy pour publier l'application en HTTPS, avec un certificat TLS. Pour aller plus loin, il y a d'autres variables d'environnement disponibles : référez-vous à cette page de la documentation. Enregistrez et fermez le fichier. Initialiser le projet Docker Compose Désormais, vous pouvez initialiser le projet Docker. Les images seront téléchargées, le réseau créé, tout comme les différents conteneurs. Patientez un instant. docker compose up -d Si vous avez une erreur, consultez les journaux : docker compose logs Il est possible que le conteneur backend refuse de démarrer à cause d'une erreur de permissions sur le dossier agent_files. Vous pouvez corriger cette erreur via la commande suivante : sudo chown -R 1000:1000 /opt/docker-compose/patchmon/agent_files Première connexion à PatchMon Ouvrez votre navigateur web et tentez d'accéder à l'interface de PatchMon, en saisissant son adresse. Saisissez l'adresse associée au paramètre CORS_ORIGIN. Pour ma part, ce sera donc : http://192.168.10.200:3000. Vous devez commencer par créer un premier compte utilisateur correspondant à l'administrateur de la plateforme PatchMon. Voilà, bienvenue sur votre instance PatchMon ! Je vous encourage à prendre le temps de parcourir les paramètres, en cliquant sur le bouton "Settings" en bas à gauche. Il y a plusieurs sections, que ce soit pour gérer les comptes utilisateurs, les rôles, votre profil, ou encore les groupes d'hôtes. Par exemple, vous pouvez activer le MFA sur votre compte administrateur. Cliquez sur "URL Config" dans la liste pour vérifier que l'adresse du serveur est bien prise en charge. C'est important de le vérifier, même si ça doit déjà être correct grâce aux variables SERVER_* configurées précédemment. Cette page affiche l'adresse qui sera utilisée par les clients pour contacter le serveur PatchMon. Si c'est incorrect, vous allez rencontrer des problèmes par la suite... Une fois que vous avez terminé votre petit tour de l'interface PatchMon, passez à la suite : le déploiement d'un premier agent. Déployer un agent PatchMon sur Linux Pour ajouter manuellement un nouvel hôte à PatchMon, vous devez déployer un nouvel agent. À partir de la section "Hosts", cliquez sur le bouton "Add host" (ou directement sur le "+" dans le menu de gauche). Pour le moment, la liste des hôtes est vide. Donnez un nom à cette machine, en toute logique le nom du serveur cible. Il est aussi possible : d'ajouter l'hôte à un groupe d'hôtes, mais par défaut il n'y a pas de groupe. C'est modifiable par la suite. d'activer une intégration, soit pour le moment l'intégration avec Docker (d'autres sont en cours de développement). Cliquez sur le bouton "Create Host" pour valider. Une fenêtre va s'afficher à l'écran. Elle indique la commande à copier-coller pour automatiser l'installation de l'agent PatchMon et l'inscription auprès du serveur. Pour ma part, la commande à exécuter est la suivante : curl -s http://192.168.10.200:3000/api/v1/hosts/install -H "X-API-ID: patchmon_2a08e8a52f0ae9fb" -H "X-API-KEY: 5bbc4e017f9c4a0ca8e485d11fd911e85e4768a38f5e832be1826d68532714e1" | sh Si vous ne lancez pas la commande directement en tant que root, vous devez ajouter sudo juste devant sh dans la seconde partie de la commande. L'opération est effectuée en quelques secondes. Les informations dans la console permettent d'avoir un aperçu des actions effectuées. Vous devriez voir passer deux lignes indiquant que les identifiants sont valides et que la connexion au serveur a été effectuée avec succès. Quelques précisions : Les identifiants de connexion à l'API sont stockés dans le fichier /etc/patchmon/credentials.yml. Le fichier de configuration, comprenant notamment l'adresse vers le serveur, est le fichier suivant : /etc/patchmon/config.yml. Le fichier journal de l'agent PatchMon est le suivant : /etc/patchmon/logs/patchmon-agent.log Suite à l'installation, l'hôte apparait bien sur l'interface de PatchMon. Vous pouvez actualiser les données en cliquant sur le bouton en haut à droite. Sur cette machine, on voit bien qu'il y a un retard considérable au niveau des mises à jour ! Note : l'agent PatchMon est équipé d'une fonction de mise à jour automatique activée par défaut. PatchMon collecte des informations générales sur la machine, en particulier pour le réseau, le système et le stockage. Vous pouvez naviguer entre les différents onglets : Sur le même principe, vous pouvez ajouter d'autres hôtes. La vue globale offrira alors une vue synthétique sur les hôtes enregistrés. Les commandes pour gérer l'agent PatchMon Voici quelques commandes utiles pour administrer l'agent PatchMon sur un serveur. Tester la connexion : patchmon-agent ping --------------------------------- ✅ API credentials are valid ✅ Connectivity test successful Lancer une synchronisation depuis l'agent : patchmon-agent report Afficher l'état de l'agent : patchmon-agent diagnostics --------------------------------- ✅ API credentials are valid ✅ Connectivity test successful root@srv-haproxy:~# patchmon-agent diagnostics PatchMon Agent Diagnostics v1.3.7 System Information: OS: Debian GNU/Linux 12 (bookworm) Architecture: amd64 Kernel: 6.1.0-25-amd64 Hostname: srv-haproxy Machine ID: 7cf53fba-b483-4621-9d3a-461833b6c214 Agent Information: Version: 1.3.7 Config File: /etc/patchmon/config.yml Credentials File: /etc/patchmon/credentials.yml Log File: /etc/patchmon/logs/patchmon-agent.log Log Level: info Configuration Status: ✅ Config file exists ✅ Credentials file exists Network Connectivity & API Credentials: Server URL: http://192.168.10.200:3000 ✅ Server is reachable ✅ API is reachable and credentials are valid Last 10 log entries: time="2026-01-08T11:06:57" level=info msg="Reboot status check completed" installed_kernel=6.1.0-25-amd64 needs_reboot=false reason= running_kernel=6.1.0-25-amd64 time="2026-01-08T11:06:57" level=info msg="Collecting package information..." time="2026-01-08T11:07:01" level=info msg="Found packages" count=360 time="2026-01-08T11:07:01" level=info msg="Collecting repository information..." time="2026-01-08T11:07:01" level=info msg="Found repositories" count=6 time="2026-01-08T11:07:01" level=info msg="Sending report to PatchMon server..." time="2026-01-08T11:07:02" level=info msg="Report sent successfully" time="2026-01-08T11:07:02" level=info msg="Processed packages" count=360 time="2026-01-08T11:07:07" level=info msg="Checking for agent updates..." time="2026-01-08T11:07:07" level=info msg="Agent is up to date" version=1.3.7 Afficher l'état du service : systemctl status patchmon-agent Afficher les logs de l'agent PatchMon : journalctl -u patchmon-agent -f Redémarrer le service : systemctl restart patchmon-agent Le monitoring de Docker avec PatchMon Si vous installez l'agent PatchMon sur une machine équipée de Docker et que vous activez l'intégration Docker, vous pourrez alors suivre l'état de vos conteneurs depuis l'interface de PatchMon. Toujours dans l'esprit monitoring, l'interface affiche l'état des conteneurs, la liste des images, des réseaux et des volumes. Pour le cas des images, ce qui est cool, c'est que PatchMon indique s'il y a une mise à jour disponible ou non, ainsi que d'autres informations (nom, tag, source, etc.). J'ai constaté qu'au début les images remontent toutes en "Up to date" (à jour), mais que l'état réel apparaît un peu plus tard. Ci-dessous, un exemple. Au niveau de chaque hôte, vous pouvez activer ou désactiver des intégrations, que l'on peut considérer comme des modules, via l'onglet "Integrations". Le site de PatchMon laisse entendre que d'autres intégrations arriveront par la suite : WordPress, Apache, Ubiquiti, Proxmox, Azure ou encore Google (vous pouvez voter d'ailleurs). Conclusion Si vous gérez déjà vos mises à jour de façon automatisée (avec Ansible, par exemple), le fait d'utiliser PatchMon ajoute une couche de monitoring intéressante pour savoir quand il est nécessaire d'agir sur tel ou tel serveur. C'est vrai pour un Home Lab et pour une petite infrastructure où PatchMon peut se faire une place pour apporter une meilleure visibilité. La solution PatchMon est jeune, mais elle évolue vite, et j'ai le sentiment qu'elle va progresser dans la bonne direction. Une communauté d'une dizaine de personnes contribue déjà au développement de la solution et le projet semble bien reçu ! Maintenant, nous attendons avec impatience la gestion des mises à jour et, pourquoi pas, à terme, la prise en charge des machines sous Windows. FAQ PatchMon Qu'est-ce que PatchMon ? PatchMon est un outil open source de surveillance des correctifs (patch monitoring) pour les systèmes Linux. Il offre un tableau de bord centralisé permettant de visualiser l'état des mises à jour (paquets installés, mises à jour de sécurité manquantes, etc.) sur l'ensemble de vos serveurs, sans avoir à s'y connecter individuellement. Il supporte aussi la découverte des conteneurs Docker et des conteneurs LXC sur les hôtes Proxmox VE. Comment fonctionne la communication entre mes serveurs et PatchMon ? L'architecture de PatchMon repose sur un modèle "agent-serveur". Un agent codé en Go est installé sur chaque machine Linux à surveiller. Cet agent initie la connexion vers votre serveur PatchMon (il est donc question d'une communication sortante uniquement). Vous n'avez pas besoin d'ouvrir de ports entrants sur vos serveurs surveillés, ce qui est un bon point pour la sécurité. Comment déployer en masse l'agent PatchMon ? La façon la plus adaptée de déployer l'agent PatchMon en masse sur un ensemble de machines Linux me semble être l'utilisation d'un playbook Ansible. D'ailleurs, au sujet d'Ansible, sachez qu'il y a un plugin d'inventaire dynamique PatchMon pour Ansible (voir cette page). PatchMon peut-il découvrir les conteneurs LXC de Proxmox VE ? Oui, PatchMon dispose d'une fonction nommée "Proxmox Auto-Enrollment" pour découvrir et inscrire automatiquement les conteneurs LXC des hôtes Proxmox VE. Le script de découverte tourne directement sur l'hôte Proxmox VE. Cette fonctionnalité est décrite sur cette page de la documentation. Ingénieur système et réseau, cofondateur d'IT-Connect et Microsoft MVP "Cloud and Datacenter Management". Je souhaite partager mon expérience et mes découvertes au travers de mes articles. Généraliste avec une attirance particulière pour les solutions Microsoft et le scripting. Bonne lecture. Afficher l’article complet -

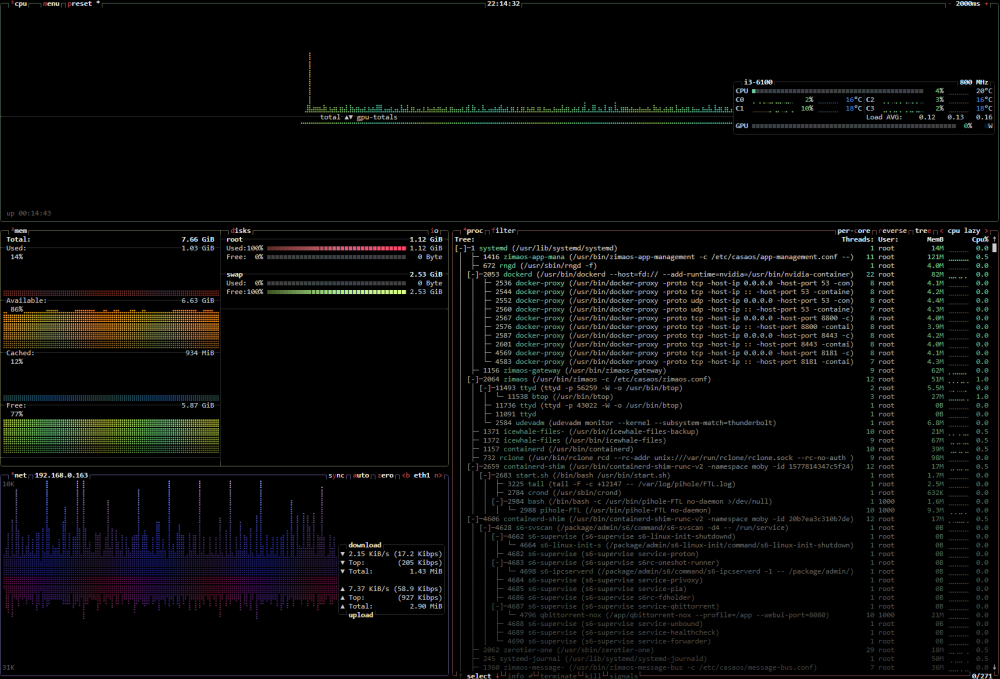

Up and Clear | Reborn upandclear.org Environ 5 minutes de lecture Après avoir mis de côté UNRAiD, dont je me suis lassé, j’ai passé le LincStation N1 sous TrueNAS. Cet OS ne m’apporte rien d’autre que la gestion simplifiée des RAIDs via une WebUI (parce que bon… mdadm… c’est chiant). Enfin je ne cherche pas à utiliser l’OS pour être précis, je ne peux donc pas dire qu’il est nul ou top. M’en tape. Les autres machines, tout aussi peu puissantes que le N1 sont sous Archlinux et Ubuntu. Arch parce que j’aime bien me demander chaque jour si une MàJ va plomber le serveur et comment je vais m’en dépatouiller (et c’est accessoirement mon desktop). Ubuntu, pour changer de Debian, parce que j’ai quand même besoin d’un truc stable dans ma vie de geek. N’utilisant quasi plus de VM/LXC depuis l’avènement de Docker, je n’ai plus de ProxMox. Du coup, je shunte Ubuntu au profit d’une distribution basée sur Debian : ZimaOS ! Jai passé hier l’ensemble de mes services « utiles » sur TrueNAS pour libérer cette machine pour ce test. Avertissement : c’est asiat’. Alors pour les complotistes américains peureux bas du front (rayez ou non les mentions inutiles), n’allez pas plus loin. Je n’ai absolument pas fait de RE pour savoir s’ils ont mis des backdoors. « Mais » CVE-2026-21891 (non encore relayée sur GitHub) / discussion Reddit et si j’ai pas sniffé le trafic, mon DNS ne fait rien ressortir d’extraordinaire. La machine ping même pas Baidu, contrairement à la majorité des objets IoT qui s’assurent d’être connectés à Internet en pingant le de Google chinoix (oui, eux aussi ont leur GAFAM BATX). J’ai découvert cet OS par hasard, quand je cherchais des infos sur des boards de serveurs. J’ai d’ailleurs commencé par découvrir CasaOS, dont j’étais pas fans. Ça faisait un peu Docker in Docker. Pour moi c’est plus à voir comme une alternative à YunoHost (très bon projet pour ceux qui sortent d’une grotte et ne connaissent pas). Même ressenti pour Cosmos d’ailleurs. ZimaOS est développé pour leurs NAS ZimaCube mais on peut l’installer partout. Ils font eux-mêmes la comparaison entre ZimaOS et CasaOS, en gros : C’est un UNRAiD like, avec une interface plus moderne (avis 100% subjectif), avec des clients à la Synology pour Windows, macOS, Linux (AUR), iOS et Android, avec une documentation bien faite sans tomber dans un Wikipedia comme on peut le voir chez certains concurrents, un GitHub et donc la possibilité d’ouvrir des issues (ce qui est bien plus pratique qu’un forum), Ça s’installe en 2-2 avec une clé USB (iso de 1.3Go) créée avec Balena et se gère uniquement via la WebUI. J’utilise la version gratuite. Et il faut activer le Mode Développeur notamment pour désactiver l’indexation du contenu avec leur « IA » (pour faciliter la recherche) et autoriser SSH. Première vraie configuration à faire, mon stockage. De mémoire j’ai que 2 disques dans ce PC mais la version gratuite permet d’en gérer 4 en RAID. Et la version payante coûte 29$ (« à vie »). Comme j’ai qu’un SSD en sus de celui de l’OS, je me contente de le formater et ça l’ajoute bien ensuite en stockage. Ce que je vois d’ailleurs avec le widget de la dashboard, qui passe à 718Go de stockage. Et donc, en standard, ZimaOS intègre un explorateur de fichiers, un outil de backup (depuis ou vers le NAS), un gestionnaire de VM et un PairDrop (je vois la machine sous Windows mais pas mon Arch, faudra que je trouve pourquoi). Depuis un client (Linux/iOS), on peut parcourir les fichiers du serveur et faire du backup. Notamment de photos depuis l’iPhone (arrière plan ou non). On peut ajouter des liens externes à la dashboard, ce qui est une très bonne idée et pourrait m’inciter à me passer de mon brave Heimdall qui m’accompagne depuis maintenant des années… Et nous terminons évidemment avec le fameux AppStore et ses 372 applications (Docker) « prêtes à installer » au moment de cet article. Rien de comparable avec UNRAiD, je vous l’accorde. Mais ici, ça s’installe en 1 clic. Et on peut ajouter des dépôts et doubler, au moins, le nombre d’applications du store. Tout comme il est possible d’installer une app via la WebUI si on elle n’est pas dans le Store et qu’on n’est vraiment pas à l’aise en console. On peut tout à fait utiliser Docker en console ou via Komodo, Arcane, Dockge, Portainer/what ever. Et ça marche « out of the box » dans ce cas, il n’y a rien à adapter pour l’OS. À noter que par défaut, les applications installées via l’AppStore sont dans /DATA, sur le disque système. root@ZimaOS:~ ➜ # tree /DATA/ /DATA/ ├── AppData │ └── pihole │ └── etc │ └── pihole │ ├── adlists.list │ ├── cli_pw │ ├── config_backups │ │ └── pihole.toml.1 │ ├── dhcp.leases │ ├── dnsmasq.conf │ ├── gravity.db │ ├── gravity_backups │ │ └── gravity.db.1 │ ├── gravity_old.db │ ├── hosts │ │ └── custom.list │ ├── listsCache │ │ ├── list.1.raw.githubusercontent.com.domains │ │ ├── list.1.raw.githubusercontent.com.domains.etag │ │ └── list.1.raw.githubusercontent.com.domains.sha1 │ ├── logrotate │ ├── migration_backup │ │ └── adlists.list │ ├── pihole-FTL.db │ ├── pihole-FTL.db-shm │ ├── pihole-FTL.db-wal │ ├── pihole.toml │ ├── tls.crt │ ├── tls.pem │ ├── tls_ca.crt │ └── versions ├── Backup ├── Documents ├── Downloads │ └── ISO ├── Gallery ├── Media │ ├── Movies │ ├── Music │ └── TV Shows └── lost+found Comme ça se voit au-dessus, j’ai installé Pi-Hole depuis l’AppStore pour tester. Faut juste cliquer pour installer. Pratique : en cas d’ajout de disques, on peut migrer les données facilement Même si ZimaOS est basé sur Debian, c’est propriétaire et on ne peut pas utiliser Apt pour y installer ce qu’on veut. C’est une sécurité également, histoire de ne pas mettre en vrac l’OS (ce qu’on est nombreux à avoir fait avec Proxmox hein… mentez pas !!). Ceci dit ils ont prévu le coup. Ceci dit, leur OS embarque déjà bon nombre d’utilitaires tels que ncdu, jq, rclone… Dans l’idéal, j’aimerais un dash qui permet de mieux intégrer quelques applications comme le font Heimdall, Homarr, Organizr etc. Aperçu du client iOS Avec le recul de cet article, je perçois ZimaOS comme un DSM de Synology, enfin plutôt un Xpenology vu qu’on peut l’installer où on veut, avec un peu de combo d’UNRAiD et cousins. Enfin tous ces OS se ressemblent mais ZimaOS serait un peu le « macOS » du groupe, à vouloir proposer une expérience très esthétique, complète (Docker natif ou magasin d’applications), pratique (outils intégrés, y compris pour périphériques) et répondant AMHA à la plupart des besoins. Bien que propriétaire, contrairement à CasaOS qui est open source mais n’est qu’une surcouche. Je pense le faire tourner quelques temps en parallèle de TrueNAS voir remplacer ce dernier. Et j’avais oublié, ça embarque aussi Btop++ pour afficher des stats temps réel. Afficher l’article complet

-

-

-

-

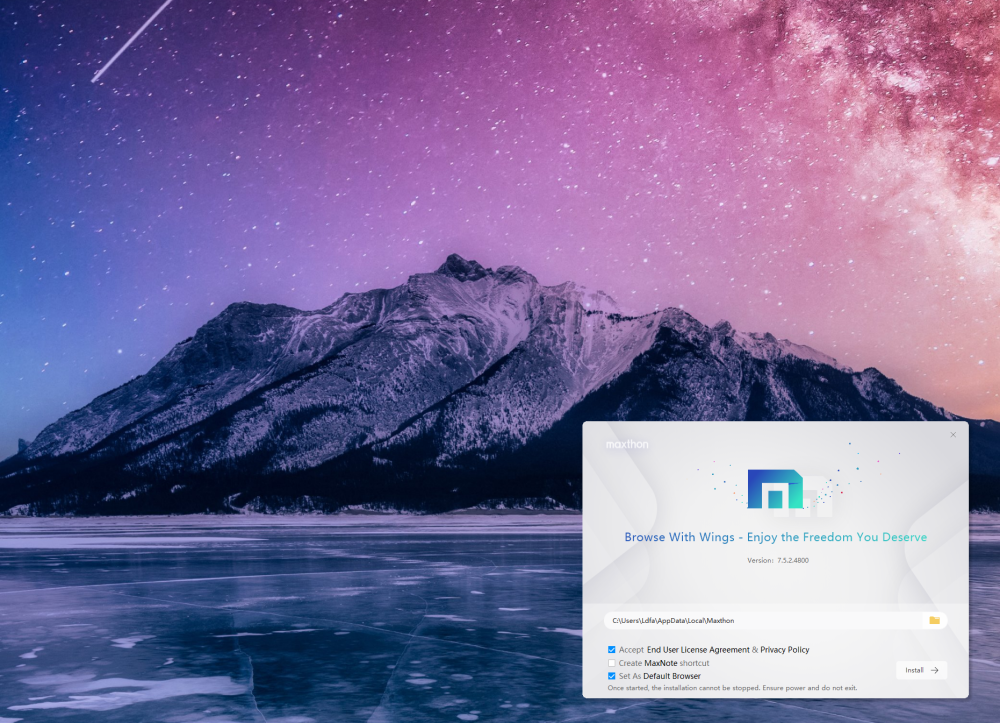

Changements principaux : - Correction d'un problème où le bouton de tri des notes ne fonctionnait pas correctement. - Correction d'un problème où la vidéo en écran partagé ne pouvait pas passer en plein écran. - Correction d'un problème avec les paramètres d'autorisation des cookies. - Correction d'un problème où le bouton Retour de la page de connexion ne répondait pas. - Correction de plantages connus.

-

Maxthon 7.5.2.4800 Bêta pour Windows est sorti aujourd'hui, il apporte son lot de nouvelles fonctionnalités, d'améliorations et de corrections de bugs. Téléchargement : https://github.com/maxthon/Maxthon/releases/ Les changements en français sont là. Vous pouvez également vous abonner au groupe Telegram NBdomain & MX6 pour faire remonter vos demandes d'améliorations et bugs rencontrés. Source : https://forum.maxthon.com/d/3061-maxthon-pc-7524800-beta

-

Radio Intercept - Un dashboard SIGINT pour votre clé RTL-SDR

Ldfa a posté un sujet dans Mon Wallabag

Le site de Korben Publié le 2 janvier 2026 Par Korben korben.info Environ 2 minutes de lecture Si vous avez une clé USB RTL-SDR qui traîne dans un tiroir et que vous vous demandez ce que vous pourriez bien en faire, j'ai peut-être trouvé le projet qui va vous occuper pendant quelques soirées. Ça s'appelle Intercept , et c'est un dashboard web qui regroupe les outils de réception radio les plus courants dans une seule interface. Comme ça, au lieu de jongler entre multimon-ng pour décoder les pagers, rtl_433 pour les capteurs météo, dump1090 pour tracker les avions... vous avez tout ça dans une seule interface Flask accessible directement sur votre navigateur. L'installation se fait via pip après un clone du repo, et certaines fonctions nécessitent des privilèges élevés (sudo) pour accéder aux interfaces réseau : git clone https://github.com/smittix/intercept.git cd intercept pip install -r requirements.txt Et pour le lancer : sudo python3 intercept.py Le truc tourne en local sur le port 5050 et agrège les données de six modules différents. Côté signaux, on peut décoder les protocoles POCSAG et FLEX (les pagers qu'utilisent encore certains services d'urgence, notamment aux États-Unis et au Royaume-Uni), surveiller la bande 433MHz où communiquent les stations météo et divers capteurs IoT. Pour le tracking, y'a un module ADS-B qui affiche les avions sur une carte OpenStreetMap avec leur trace historique, et un autre pour les satellites qui prédit les prochains passages au-dessus de votre position. Là où ça devient plus... disons "sensible", c'est avec les modules WiFi et Bluetooth. Le premier peut passer votre carte en mode monitor pour analyser les réseaux environnants et, si un client se reconnecte au bon moment, capturer des handshakes WPA. Le second scanne les appareils Bluetooth à portée. Évidemment, selon les lois de votre pays, ce genre d'analyse peut être encadré voire interdit sur des équipements tiers donc renseignez vous bien avant d'aller en prison bêtement. Le projet affiche d'ailleurs un gros disclaimer au lancement. Techniquement, c'est du Python avec Flask pour le backend, Leaflet.js pour les cartes, et des Server-Sent Events pour le streaming en temps réel. L'interface propose un thème sombre ou clair, des alertes sonores configurables, et l'export des données en CSV ou JSON. Y'a même des raccourcis clavier pour les power users. Pour faire tourner le bazar, il vous faut un dongle RTL-SDR compatible (les modèles à base de RTL2832U font l'affaire), une carte WiFi supportant le mode monitor si vous voulez cette fonction, et les dépendances habituelles : rtl-sdr, multimon-ng, rtl_433, dump1090, aircrack-ng pour le WiFi et BlueZ pour le Bluetooth . Le projet est sous licence MIT, développé par smittix avec l'aide de quelques contributeurs. Ça me rappelle un peu l'époque où on bidouillait avec les femtocells pour intercepter les communications , sauf qu'ici c'est packagé proprement et ça ne nécessite pas de souder quoi que ce soit. Si vous cherchez un projet pour apprendre les bases de l'intelligence des signaux radio ou juste pour voir ce qui se passe dans les ondes autour de vous, c'est un excellent point de départ. Par contre, je vous recommande vraiment de lire les lois de votre pays sur l'interception des communications avant de brancher quoi que ce soit... Afficher l’article complet -

Linux Glances : superviser votre système Linux facilement - IT-Connect

Ldfa a posté un sujet dans Mon Wallabag

www.it-connect.fr Publié le 11 décembre 2025 it-connect.fr Environ 8 minutes de lecture La supervision d'un système Linux directement depuis le Terminal, c'est possible avec Glances. Un outil open source qui va vous faire oublier les commandes top et htop, bien qu'elles restent classiques pour tout administrateur système. Glances propose une approche modernisée avec des options supplémentaires pour visualiser l'état de santé de vos machines en un clin d'œil. Glances est particulièrement pertinent pour : Consulter rapidement l'état général d'un système avec une seule et unique commande, Diagnostiquer un goulot d'étranglement (CPU, I/O disque ou RAM) sur un serveur de production, Mettre en place une surveillance légère via une interface web sur une machine dépourvue d'interface graphique. <iframe class="iframe_youtube" src="https://www.youtube.com/embed/-jg9wvVqBHk" title="Glances : la supervision système facile dans le Terminal" frameborder="0" referrerpolicy="strict-origin-when-cross-origin" allowfullscreen="allowfullscreen">[embedded content]</iframe> Glances est un outil de supervision système libre développé en langage Python. Il a été créé il y a plus de 10 ans par un Français : Nicolas Hennion, connu sous le pseudo de Nicolargo. Sa particularité : il affiche un état complet d'un système directement dans le terminal, ce qui est particulièrement intéressant sur les serveurs où les interactions s'effectuent uniquement en ligne de commande. Site officiel de Glances GitHub de Glances Même si je le présente ici dans le contexte de Linux, Glances présente la particularité de fonctionner sur de multiples plateformes : GNU/Linux, macOS, Windows et FreeBSD. Il prend en charge trois modes d'exécution différents : Standalone : exécution locale classique dans le terminal. Client/Serveur : surveillance à distance. Web Server : affichage des métriques directement via votre navigateur web. L'objectif de Glances n'est pas de remplacer un outil de supervision complet, où vous aurez des alertes et un historique, mais d'offrir un tableau de bord complet et immédiat. Pour autant, Glances peut communiquer avec d'autres applications grâce à son API. Il prend aussi l'export des données via InfluxDB ou vers un simple fichier CSV. On peut aussi nommer la possibilité d'exporter vers Prometheus pour ensuite afficher les informations avec Grafana. Puisque Glances est développé en Python, il a besoin de Python. Pour l'installer, il y a plusieurs méthodes envisageables : installer directement le paquet glances (et ses dépendances) via apt sur Debian / Ubuntu, ou encore directement avec pipx. Il est dans la majorité des dépôts officiels des distributions Linux. C'est la méthode la plus simple pour une intégration rapide, bien que la version distribuée ne soit pas nécessairement la dernière. Par exemple, actuellement, Debian 13 distribue la version 4.3.1 alors que la plus récente est la 4.4.1. Pour installer Glances sur Debian ou Ubuntu : sudo apt update sudo apt install glances Comme le montre l'image ci-dessous, de nombreuses dépendances Python seront aussi installées. Une fois tous les paquets installés, vous pouvez profiter de Glances ! Pour bénéficier des dernières fonctionnalités, l'installation avec Pipx directement via Python est recommandée. Vous devez, au préalable, installer Python sur votre machine et préparer votre environnement. # Installation de Glances avec pipx (toutes les fonctionnalités activées) pipx install 'glances[all]' # Installation de Glances avec pip (toutes les fonctionnalités activées) pip install --user glances[all] # Installation de base de Glances + interface web pipx install --user 'glances[web]' Vous pouvez retrouver le détail des fonctionnalités sur cette page du site PyPi. Des images Docker de Glances sont disponibles sur le Docker Hub. C'est plutôt intéressant car cela évite d'installer Glances et toutes ses dépendances sur la machine si vous disposez de Docker. Sachez que Glances est aussi compatible avec LXC. Ci-dessous un exemple de fichier Docker Compose (docker-compose.yml) pour déployer Glances avec Docker : services: glances: container_name: glances image: nicolargo/glances:latest ports: - 61208:61208 environment: - TZ=Europe/Paris - GLANCES_OPT=-w pid: host restart: unless-stopped volumes: - /var/run/docker.sock:/var/run/docker.sock:ro L'application Glances sera accessible via un navigateur web sur l'adresse de l'hôte Docker, via le port 61208 : http://<IP Docker>:61208. Cela est possible grâce à l'activation de l'interface web de Glances via GLANCES_OPT=-w. Pour aller plus loin, voici un autre exemple où Glances est publié via Traefik et l'accès à son interface est protégé par une page d'authentification Tinyauth. services: glances: container_name: glances image: nicolargo/glances:latest environment: - TZ=Europe/Paris - GLANCES_OPT=-w pid: host restart: unless-stopped volumes: - /var/run/docker.sock:/var/run/docker.sock:ro networks: - frontend labels: - traefik.enable=true - traefik.http.routers.glances-https.rule=Host(`glances.domaine.fr`) - traefik.http.routers.glances-https.entrypoints=websecure - traefik.http.routers.glances-https.tls=true - traefik.http.routers.glances-https.tls.certresolver=ovhcloud - traefik.http.routers.glances-https.middlewares=crowdsec@file,tinyauth - traefik.http.services.glances-https.loadbalancer.server.port=61208 - tinyauth.apps.glances.config.domain=glances.domaine.fr - tinyauth.apps.glances.users.allow=adm_fb networks: frontend: external: true Remarque : si vous envisagez de personnaliser la configuration de Glances, vous devez ajouter un volume pour le fichier glances.conf. Par exemple : - "./glances.conf:/glances/conf/glances.conf". D'autres exemples sont disponibles sur GitHub du projet Glances : Docker Compose Glances. Pour lancer l'outil, ouvrez simplement votre terminal et tapez cette commande : glances L'interface de Glances apparaît immédiatement à l'écran. Elle se divise en plusieurs zones dynamiques où les informations sont actualisées en permanence (avec un délai d'actualisation de 2 secondes par défaut). Sur les versions récentes, il y a aussi un mode plus synthétique pour obtenir un résumé de votre machine. Ce mode s'exécute de cette façon : glances --fetch C'est probablement l'une des fonctionnalités les plus appréciées. Glances peut lancer un petit serveur web intégré, vous permettant de consulter vos métriques depuis n'importe quel navigateur, y compris sur mobile. Pour lancer ce mode, rajoutez simplement cette option : glances -w Glances Web User Interface started on http://0.0.0.0:61208/ Glances RESTful API Server started on http://0.0.0.0:61208/api/4 Announce the Glances server on the LAN (using 0.0.0.0 IP address) INFO: Started server process [5087] INFO: Waiting for application startup. INFO: Application startup complete. INFO: Uvicorn running on http://0.0.0.0:61208 (Press CTRL+C to quit) Le terminal affiche un message précisant que Glances écoute sur http://0.0.0.0:61208. Vous pouvez donc y accéder en local ou à distance en précisant l'adresse IP de votre machine. Note : par défaut, le mode web est ouvert à tous. Il est conseillé de définir un mot de passe avec l'option --password. Ce qui donne : glances -w --password. Il conviendra alors de définir un mot de passe associé au compte utilisateur glances (pour changer, utilisez --username). Ce mode permet de centraliser la surveillance. Vous lancez Glances en mode "serveur" sur la machine à surveiller, et vous vous y connectez depuis votre poste de travail (le client). Sur le serveur (la machine à surveiller) : glances -s Sur la machine de supervision (client) : glances -c <IP_SERVEUR_GLANCES> L'interface de Glances, qu'elle s'affiche dans le Terminal ou via la page Web, affiche un ensemble de métriques sur votre système. Ces informations sont réparties dans un ensemble de zones. La zone principale se situe en bas à droite et donne un aperçu sur tous les processus en cours d'exécution sur la machine. Il y a plusieurs métriques, dont : usage du CPU, usage de la RAM, PID, temps d'exécution, le compte associé, ou encore la commande complète ou le service associé au processus. Juste au-dessus, vous avez la liste des conteneurs en cours d'exécution sur la machine locale. Avec là encore, des métriques spécifiques : le nom du conteneur, le statut, l'uptime, la consommation en RAM et CPU, et les ports exposés. Glances supporte Docker et Podman. En complément, il y a d'autres zones permettant d'avoir des informations sur l'état du stockage, l'état du réseau, la charge globale du système sur 1, 5 et 15 minutes, et la charge de la RAM et du CPU à l'échelle du système. Glances utilise un système de seuils colorés pour attirer votre attention, ce qui facilite la lecture rapide : Vert (OK) : tout est normal. Bleu (Careful) : une vigilance est requise (exemple : CPU > 50%). Violet (Warning) : la charge est élevée (exemple : CPU > 70%). Rouge (Critical) : le système est en situation critique (exemple : CPU > 90%). Ces seuils sont entièrement configurables via le fichier de configuration glances.conf. Bien qu'il y ait quelques zones cliquables, la navigation sur l'interface de Glances s'effectue majoritairement au clavier. Au-delà de la navigation avec les flèches directionnelles, voici quelques raccourcis pratiques : c : trier les processus par utilisation CPU. m : trier les processus par utilisation mémoire. p : trier les processus par nom. q : quitter l’application. L'aide, accessible via la touche h du clavier, permet d'obtenir la liste complète des raccourcis clavier : Glances dispose d'un fichier de configuration en mode texte que vous pouvez utiliser pour affiner le comportement de la solution. Ce n'est pas obligatoire d'éditer la configuration, car Glances est prêt à l'emploi dès sa sortie de boite. Sur Linux (Debian/Ubuntu), le fichier de configuration est le suivant : /etc/glances/glances.conf. Si vous utilisez Glances sur Windows, ce sera bien entendu différent : %APPDATA%\glances\glances.conf. Vous pouvez notamment utiliser ce fichier de configuration pour personnaliser les seuils d'alerte de Glances et la fréquence à laquelle les données doivent être rafraichies. Le fichier de configuration commence par la section [global] : [global] # Temps d'actualisation global, personnalisable au niveau de chaque module # Par exemple, un temps d'actualisation plus rapide pour le CPU. refresh=2 # Vérifier la présence de mises à jour check_update=true # Taille de l'historique, en nombre de valeurs # 1200 valeurs = 1 heure avec le refresh à 2 secondes history_size=1200 Il y a ensuite des sections par module, par exemple [system] (première ligne de l'interface Glances), [cpu] pour les informations globales sur le processeur ou encore [mem] pour la RAM. Vous avez à chaque fois des paramètres communs, comme disable=False si un module est activé, et des paramètres pour la personnalisation des seuils (careful, warning, critical). Par ailleurs, vous pouvez configurer l'exporter Prometheus pour ensuite afficher les informations avec Grafana. Cette configuration s'effectue dans le même fichier de configuration, via la section [prometheus]. Voici la configuration suggérée (et par défaut) : [prometheus] host=localhost port=9091 prefix=glances labels=src:glance Pour activer l'export, vous devez lancer Glances de cette façon : glances --export prometheus Pour en savoir plus et obtenir des précisions sur les paramètres, consultez cette page : Documentation Glances - Configuration. Glances se positionne comme un outil de monitoring "tout-en-un" très pertinent pour l'administration système quotidienne. Sa capacité à s'exécuter en mode web ou client/serveur lui confère une polyvalence que les outils standards n'ont pas toujours. Bien qu'il ne remplace pas une solution de supervision complète comme Centreon ou Zabbix pour l'historisation à long terme, il est un allié de choix pour l'analyse en temps réel. Afficher l’article complet -

Google uBlacklist - Reprenez le contrôle de Google | Le site de Korben

Ldfa a posté un sujet dans Mon Wallabag

korben.info Publié le 24 septembre 2025 korben.info Environ 3 minutes de lecture Vous connaissez sans doute ce petit moment de haine, quand Google vous balance pour la 50ème fois ce même site de merde qui diffuse la doc Python mal traduite avec ChatGPT ? Ou alors quand vous cherchez une recette de cuisine tout simple et que Pinterest squatte la moitié des résultats avec ses images floues et ses popups de connexion obligatoire ? Bon bah aujourd’hui, ça c’est fini, car on va faire le ménage là-dedans. Et comment on va faire ? Et bien je vous le donne en mille Emile, on va utiliser pour cela uBlacklist , une extension créée par un certain Iorate qui permet de faire le ménage dans les résultats de recherche. uBlacklist, c’est la Marie Kondo du web. L’objectif c’est de garder uniquement les sites qui nous procurent de la joie ? Vous allez pouvoir virer les sites qui pourrissent vos recherches Google et croyez-moi, ça fait un bien fou !! Ce truc fonctionne sur Chrome, Firefox et même Safari. Pour l’installer, direction le Chrome Web Store ou les add-ons Firefox et une fois en place, vous allez voir apparaître des petites icones “Bloquer ce site” directement dans vos résultats Google. Un clic et pouf, le site disparaît à jamais de vos recherches. C’est le kiff non ? Mais là où ça devient vraiment intéressant, c’est avec les listes publiques. Parce que oui, des gens ont déjà fait le boulot pour vous. Il existe en effet des listes pour bloquer les sites générés par IA , des listes anti-Pinterest, des listes contre les fermes de contenu SEO… C’est un peu comme les listes de blocage pour uBlock Origin, mais pour les résultats de recherche. Bref, la communauté s’organise pour nettoyer collectivement le web de ses parasites. Et cette extension ne se contente pas de Google. Elle fonctionne aussi avec Bing, DuckDuckGo, Brave, Ecosia, et même Yandex pour nos amis de l’Est. Et cerise sur le gâteau, vous pouvez aussi synchroniser vos listes de blocage entre tous vos appareils via Google Drive ou autres service de stockage dans le cloud. Comme ça, le ménage que vous faites sur votre PC, vous le retrouvez automatiquement sur votre téléphone. Pour les power users, uBlacklist permet même d’utiliser des patterns avancés et même des expressions régulières. Vous pouvez ainsi bloquer *://*.pinterest.*/* d’un coup pour dire adieu à toutes les variantes de Pinterest. Ou créer des règles complexes qui bloquent seulement certaines sections de sites. Faire du sur-mesure, quoi… Google, l’entreprise qui était censée “organiser” l’information mondiale, est de toute façon devenue tellement polluée par le spam SEO, les sites IA et les fermes de contenu, qu’on ne peut plus s’en sortir sans cette extension… Tu m’étonnes que les gens lui préfèrent de plus en plus Perplexity… L’arrivée de cette extension me rappelle un peu cette époque où les gens ont commencé à bloquer massivement les pubs… ça a forcé tout l’écosystème publicitaire à évoluer et aujourd’hui avec uBlacklist et ses copains, on fait passer un peu le même message en disant aux moteurs de recherche : “non, on ne veut plus de ces sites de merde dans nos recherches”. C’est triste d’en arriver là, mais au moins, on n’est plus obligés de subir les algos Google ou d’autres moteurs… Bref, si vous en avez marre de tomber sur les mêmes sites pourris à chaque recherche, foncez installer uBlacklist et n’hésitez pas à partager vos listes de blocage sur le Discord . Et pour ceux qui veulent aller plus loin, il y a aussi le Super-SEO-Spam-Suppressor sur GitHub qui propose une approche très “Anticapitaliste” du blocage de spam. Hé oui, même le blocage de sites devient politique maintenant. On vit vraiment une époque formidable ! Afficher l’article complet -

Jeux vidéo Patch pour WeMod (Pro) : mods & trainers pour jeux PC - UpAndClear.org

Ldfa a posté un sujet dans Mon Wallabag

upandclear.org upandclear.org Environ 1 minute de lecture Je fais partie de ceux qui trichent de temps en temps sur les jeux solo/offline. Très souvent pour des munitions illimitées du moins, plus que de la santé illimitée qui fait complètement perdre son intérêt au jeu de mon point de vue. Utilisateur du célèbre gamecopyworld des années, je suis passé depuis un bout de temps sur WeMod qui rend ça plus simple puisque cette application regroupe les mods et cheats de très nombreux jeux PC (3600+) et permet de les utiliser simplement (en ajoutant le .exe du jeu par exemple). Ce n’est pas le seul outil pour ça mais eux ont débuté avec des mods pour Xbox360, ça remonte. Il ne permet PAS de tricher sur les jeux en ligne. Bien entendu, certains jeux en ligne ne se lancent pas quand ils détectent WeMod de lancé (anti-cheats), il faudra donc le couper quand on ne veut pas chiller solo. Certaines fonctionnalités sont cependant derrière un paywall. J’ai déjà payé un an par le passé et estime jouer vraiment trop peu en utilisant WeMod pour repayer. J’ai trouvé un patcher pour WeMod sur GitHub, qui simule un abonnement pro sur l’outil et débloque donc toutes les fonctionnalités. Ça peut dépanner… Au cas où, je le stocke également sur le blog. J’ai laissé la sélection du patch par défaut Il a foiré et c’est passé à la seconde méthode automatiquement, avec ssucès Afficher l’article complet -

www.cachem.fr Publié le 24 octobre 2025 cachem.fr Environ 2 minutes de lecture Après une année de développement et de tests intensifs, Jellyfin 10.11.0 marque l’une des évolutions les plus importantes du projet open source. Cette nouvelle version met l’accent sur la performance, la fiabilité et la préparation du futur, avec une refonte du système de gestion des métadonnées, de nouveaux outils d’administration et plusieurs améliorations côté utilisateur. Regardons de plus près cette nouvelle version… Jellyfin 10.11.0 : le changement, c’est maintenant Visuellement, Jellyfin 10.11.0 n’apporte que peu de modifications. Les véritables avancées se situent à l’intérieur du moteur : la base de données de la bibliothèque a été entièrement migrée vers EF Core. Concrètement, Jellyfin abandonne les requêtes SQLite dispersées au profit d’une gestion centralisée des données. Résultat : des requêtes plus rapides, des migrations plus sûres, et une base bien plus facile à faire évoluer. Cette refonte ouvre également la voie à la prise en charge future d’autres moteurs de base de données, comme PostgreSQL, pour plus de flexibilité et de robustesse. Maintenance simplifiée La migration des bibliothèques s’accompagne d’un processus de déduplication et de nettoyage des données (suppression d’entrées orphelines ou doublons). Selon la taille et l’ancienneté de la base, cette étape peut durer de quelques minutes à plusieurs heures. Avant toute mise à jour, il est impératif de : sauvegarder manuellement les dossiers de données et de configuration, être déjà sur la version 10.10.7, et ne jamais interrompre la migration en cours. Autre nouveauté appréciable : la fonction de sauvegarde et restauration intégrée. Elle permet de créer des instantanés (snapshots) de la base de métadonnées et de les restaurer facilement, un vrai plus pour la maintenance et la sécurité des données. Performances et consommation mémoire Le moteur de base de données tire désormais parti d’un cache en mémoire plus agressif, ce qui réduit les accès disque et améliore nettement la réactivité, notamment sur les grandes bibliothèques. En contrepartie, Jellyfin utilise davantage de RAM, mais cette mémoire est libérée automatiquement si d’autres processus en ont besoin. De nouveaux modes de verrouillage (locking) viennent aussi améliorer la stabilité dans les environnements sollicités. Compatibilité et évolutions techniques Jellyfin abandonne définitivement le support des systèmes ARM 32 bits (armhf). Pour continuer à bénéficier des mises à jour, il faut désormais utiliser un système d’exploitation ARM64. Autre changement annoncé : la suppression prochaine du support TLS/SSL interne (prévue pour la version 10.12.0). Les développeurs recommandent désormais d’utiliser un reverse proxy (comme Nginx ou Caddy) pour la gestion des certificats, plus fiable et plus simple à maintenir. Nouvelles fonctionnalités et améliorations clés Parmi les nouveautés les plus notables de Jellyfin 10.11.0 : Recherche plus rapide et gestion enrichie des favoris (Live TV, clips, albums photo, saisons, etc.) ; Support HEVC dans Firefox 134+ et option pour désactiver le style natif des sous-titres ; Affichage en collections des séries et ajout d’un splash screen personnalisable sur la page de connexion ; Tableau de bord enrichi, avec statistiques médias et suivi de l’espace disque ; Support AV1 via VideoToolbox et passage à FFmpeg 7.1, pour de meilleures performances en décodage et transcodage ; Amélioration du rendu HDR et Dolby Vision sur certains matériels compatibles ; Nouvelle API de sauvegarde (BackupApi) et migration complète des plugins vers EF Core. Cette version corrige également plusieurs failles de sécurité, y compris des correctifs issus de projets externes. En synthèse Jellyfin 10.11.0 pose des fondations solides pour l’avenir du projet. Plus rapide, plus stable et mieux structurée, cette version facilite la maintenance tout en préparant de futures innovations. Une mise à jour vivement conseillée, à condition de la planifier avec soin…. pensez aux sauvegardes. source Afficher l’article complet

-

Smartphone GrapheneOS quitte la France et OVHcloud : pourquoi ? - IT Connect

Ldfa a posté un sujet dans Mon Wallabag

www.it-connect.fr Publié le 28 novembre 2025 it-connect.fr Environ 4 minutes de lecture GrapheneOS, c'est quoi ? Suite à la polémique associée à l'article du Parisien, GrapheneOS a annoncé l’arrêt complet de son infrastructure en France, accélérant son retrait d’OVH et dénonçant un climat juridique de plus en plus hostile aux projets liés à la protection de la vie privée. GrapheneOS est un système d'exploitation durci pour mobile pensé pour être respectueux de votre vie privée et sécurisé. Il se base sur le projet Android Open Source Project (AOSP) et chaque amélioration est pensée dans une même logique : ne pas augmenter la surface d'attaque. Par exemple, pour vous protéger contre les menaces, GrapheneOS dispose d'un système de sandbox avancé qui agit à différents niveaux, notamment au niveau des composants, des applications et des espaces de travail. Il représente une alternative aux versions classiques d'Android modifiées par les constructeurs et il est dépourvu des services et applications de Google. "Nous ne sommes pas contre le fait que les utilisateurs utilisent les services Google, mais ceux-ci ne devraient pas être intégrés au système d'exploitation de manière invasive.", peut-on lire sur le site du projet. Malgré tout, GrapheneOS ne ferme pas la porte aux outils de Google. Il intègre notamment une couche de compatibilité offrant la possibilité d'utiliser le Google Play Store par l'intermédiaire d'une sandbox. Même lorsqu'il est installé, GrapheneOS ne l'utilisera pas pour fonctionner. Il est à noter que GrapheneOS est compatible avec une seule gamme de smartphones : les Google Pixel. D'après l'équipe de développement, il n'y a qu'avec ces appareils produits par Google qu'il est possible d'aller aussi loin dans la personnalisation pour améliorer la sécurité. Une exclusivité qui pourrait évoluer par la suite : la balle est dans le camp des constructeurs. Vous pouvez visiter le site de GrapheneOS pour en savoir plus. Le Parisien met le feu aux poudres Le 19 novembre 2025, Le Parisien a publié un article de presse dans lequel GrapheneOS est présenté comme la solution ultime utilisée par les narcotrafiquants pour échapper aux forces de l'ordre. "La nouvelle méthode des trafiquants pour échanger à l’abri de la justice : le téléphone Google Pixel et le système d’exploitation GrapheneOS.", peut-on lire dans les premières lignes de cet article. Il fait notamment référence à une affaire de narcotrafic en particulier : "Il y a quelques mois, lors de la fouille du chef présumé du tentaculaire réseau francilien Omar, les enquêteurs de la brigade des stupéfiants ont mis la main sur un téléphone Google Pixel. À l’instant où les informaticiens de la police ont tenté de l’exploiter, l’appareil s’est mystérieusement réinitialisé. Le juge parisien en charge du dossier devra donc se passer du contenu du téléphone pour mener ses investigations contre Bilel.", peut-on lire. Cette publication est à l'origine d'une polémique importante, au point que l'équipe de GrapheneOS a pris une décision immédiate : quitter la France. Désormais, GrapheneOS a entamé une restructuration de son infrastructure informatique afin d’échapper à la juridiction française. Dans le même temps, ils envisagent de quitter OVHcloud, le géant français du Cloud. "Nous n'avons plus aucun serveur actif en France et poursuivons le processus de départ d'OVH. Nous allons faire tourner nos clés TLS et les clés de compte Let's Encrypt épinglées via accounturi. Les clés DNSSEC pourraient également être renouvelées. Nos sauvegardes sont chiffrées et peuvent rester chez OVH pour le moment.", peut-on lire dans un post X. Dans l'immédiat, plusieurs services de GrapheneOS (e-mail, Matrix, forums, Mastodon, etc.) vont migrer à court terme d'OVHcloud Canada vers Netcup en Allemagne, avant un nouvel hébergement à Toronto, toujours au Canada. Par ailleurs, les miroirs de mise à jour sont désormais hébergés à Los Angeles, Miami et Londres. La France critiquée par l'équipe de GrapheneOS Les développeurs affirment que la France est devenue un environnement hostile pour les projets open source axés sur la confidentialité. Pour eux, la France est un pays de plus en plus autoritaire. Forcément, ces propos font écho à l'envie du gouvernement d'introduire des portes dérobées dans les mécanismes de chiffrement (dans le cadre du projet de loi Narcotrafic). On peut aussi citer le projet de loi ChatControl, qui n'est pas encore mort. Selon l’équipe de GrapheneOS, les réquisitions visant à obtenir un accès aux smartphones chiffrés relèvent tout simplement de l’impossible sur le plan technique. En cause : les Secure Elements (SE), ces composants matériels isolés qui gèrent les protections anti-brute force et ne s’exécutent que via des mises à jour de firmware signées, en plus d’exiger l’authentification de l’utilisateur. C'est le modèle de sécurité utilisé qui impose ce haut niveau de sécurité. Un parallèle est également fait entre le Canada et la France. En effet, là où le Canada ou les États-Unis protègent le refus de divulguer un mot de passe au nom du droit à ne pas s’auto-incriminer, la France pénalise ce refus, ce qui supprime une garantie essentielle pour la protection de la vie privée. Comme beaucoup d’outils axés sur la sécurité et la protection de la vie privée, GrapheneOS peut être détourné de son objectif initial, mais cela ne justifie pas de l’associer directement au narcotrafic. Ce rapprochement n'est pas nécessaire, ni judicieux. Qu'en pensez-vous ? Afficher l’article complet -

Linux TrueNAS CE : le gestionnaire de stockage basique et simple - UpAndClear

Ldfa a posté un sujet dans Mon Wallabag

upandclear.org upandclear.org Environ 5 minutes de lecture J’ai migré mon LincStation N1 d’UNRAiD à TrueNAS CE (ex TrueNAS Scale, ex FreeNAS), que je redécouvre avec grand plaisir. EDIT : on peut passer l’interface en français dans les options, tout comme on peut choisir son shell (zsh de base, je suis repassé en Bash) EDIT2 : oui, mon titre est réducteur. Très longtemps utilisateur de ProxMox, depuis l’avènement de Docker je me servais de moins en moins les VM/CT. Après l’avoir utilisé avec Docker (directement sur l’hôte), j’ai ensuite bifurqué sur du 100% Linux sans interface chez moi avec Debian, Ubuntu et ArchLinux. Ce dernier n’étant pas le plus stable pour un serveur, vu le principe de rolling release, il faut être à l’aise avec Arch dans ce contexte. Trouvant OpenMediaVault inadapté à mes besoins, Xpenology (comme un hackintosh mais pour DSM de Synology) encore moins pour un serveur de prod, j’avais fait un passage par TrueNAS Scale à l’époque mais le trouvais là encore trop peu pratique dans mon cas (manquant de simplicité). En me rapprochant de SuperBoki, je m’étais acheté une licence Pro à vie d’UNRAiD puis un LincStation N1 à l’occasion de sa promotion sur le site d’UNRAiD. Petit serveur, aussi bien physiquement qu’en terme de ressources, ce petit NAS basse consommation répond toujours très bien à mes besoins (hors post sur Usenet, le pauvre CPU ayant morflé quelques fois…). Au fil du temps, j’allais surtout sur UNRAiD pour parcourir le magasin d’applications et faire quelques découvertes, UNRAiD étant très populaire chez les hoarders et dans l’univers de l’auto-hébergement lié au P2P and co. Mais je n’y allais que pour ça. Au final, UNRAiD ne me servait qu’à avoir une gestion simplifiée et très user-friendly du stockage. Je gérais, quasi depuis le début, mes Dockers comme j’aime, donc pas via UNRAiD : en console, via Dockge voire Portainer ou plus récemment Arcane. Des outils qui, à mon sens, ne dépendant pas de l’OS, permettent une plus grande liberté d’actions, manipulations et migrations entre machines (j’en ai actuellement 3 au garage). Et en plus quand un truc tourne rond, je suis de ceux qui ne sont pas contents, je pense que c’est le lot des bidouilleurs. J’ai récemment remisé dans un tiroir ma clé USB UNRAiD et décidé passer ce petit NAS sous TrueNAS CE, l’évolution de Scale (donc la version gratuite). Mon but cette fois-ci était précis : trouver un gestionnaire de stockage simple et efficace, qui me laisse beaucoup de liberté de gestion tout en me permettant de gérer mon stockage de manière très intuitive (autrement qu’en console via mdadm). Je ne vais pas présenter l’OS vu que je ne m’y suis pas vraiment attardé autrement que pour la gestion des disques et partages. Il permet de créer VM, CT et mettre en place des Dockers. Il propose, comme UNRAiD mais bien moins fourni, un magasin d’applications (environ 300 pour l’instant, rien de comparable à UNRAiD donc et logiquement orientées pro/services plus que P2P etc). J’utilise ZFS pour créer mes pools (des VDEVs) de stockage. Docker, RAID1 de 2 NVMe de 250Go. Ne remplace pas une sauvegarde régulière mais me permet la perte d’un disque pour reconstruire le RAID sans perdre les données. Fichiers, en stripped (RAID0) de 2 SSD de 2To. Si un disque meurt, tout le pool est irrécupérable. Dédié à BitTorrent etc, que des données que je peux perdre. Usenet, composé d’un seul disque NVMe d’1To. Parce que je ne savais vraiment pas quoi en faire… Il pourrait me servir à faire un peu de DL/Post pour Usenet. Il me reste encore un disque d’inutilisé. Si je décide de remettre Plex/Jellyfin, il pourrait servir de cache. J’ai pas utilisé de chiffrement, il n’y a aucun service confidentiel dessus et en plus c’est stocké chez moi. Je fais des backups de mes Dockers à l’ancienne via un script Bash pour l’instant (oui je sais, on arrive en 2026). Il va falloir que je me penche sur les options intégrées à TruenAS ! J’aime la gestion simplifiée des services Idem pour les partages. On voit d’ailleurs que j’ai fait en sorte de pouvoir monter Fichiers sur mon Windows de jeu, vu que j’ai le temps de jouer en ce moment (…) pour récupérer mes jeux téléchargés. Là encore, la gestion des utilisateurs est étonnante de simplicité et pourtant très complète Je redécouvre cet OS avec grand plaisir, notamment avec le recul que j’ai pris à écrire cet article. Je le trouve bluffant de simplicité sans pour autant faire de concession sur la sécurité ou les options. Même si j’ai conscience de ne pas l’exploiter, j’ai enfin trouvé un OS qui répond à mes besoins du moment, se configure en 8 minutes et me laisse libre de l’utiliser comme bon me semble. On peut gérer cron et systemd via ses options également. Ravi d’avoir retenté l’expérience TrueNAS 🙂 Afficher l’article complet -

Fibre optique Déploiement et architecture du réseau FTTH en France - NetworkPulse.fr

Ldfa a posté un sujet dans Mon Wallabag

Déploiement et architecture du réseau FTTH en France Architecture réseau FTTH de A à Z : équipements (NRO, SRO, PCO, PTO, ONT), préparation client, interprétation des paramètres optiques et FAQ technique. Le déploiement de la fibre optique en France s'appuie sur une architecture normalisée appelée FTTH (Fiber To The Home - Fibre jusqu'à l'abonné). Ce tutoriel s'adresse aux professionnels du secteur des télécommunications mais aussi aux particuliers et détaille l'architecture complète d'un réseau FTTH, de l'équipement central jusqu'au domicile de l'abonné. Architecture générale du réseau FTTH Un réseau FTTH se compose de plusieurs équipements interconnectés par fibre optique, formant une chaîne de transmission du signal depuis le central opérateur jusqu'au domicile du client. Cette architecture repose sur le principe de distribution point-à-multipoint utilisant la technologie PON (Passive Optical Network), majoritairement GPON (Gigabit PON) ou XGS-PON (10 Gigabit Symmetrical PON) en France. L'OLT - Optical Line Terminal (nœud de raccordement optique) Définition et rôle L'OLT (Optical Line Terminal), également appelé NRO (Nœud de Raccordement Optique) en France, constitue le point de départ du réseau FTTH. Cet équipement actif est situé dans le central technique de l'opérateur ou dans un local dédié. Fonctions principales Génération du signal optique : L'OLT convertit les signaux électriques provenant du réseau de collecte en signaux optiques Multiplexage : Il gère simultanément plusieurs longueurs d'onde pour la transmission bidirectionnelle Multiplexage : Il gère simultanément plusieurs longueurs d'onde pour la transmission bidirectionnelle Gestion du réseau : Pilotage des débits, authentification des ONT, supervision de la qualité du signal Point de concentration : Un seul OLT peut desservir plusieurs milliers d'abonnés Caractéristiques techniques L'OLT émet généralement sur une longueur d'onde de 1490 nm (données) et 1550 nm (télévision) en descendant, et reçoit sur 1310 nm en montant. Il intègre des cartes PON, chacune supportant typiquement 16 à 64 ports optiques. Le SRO - Sous-répartiteur optique Définition et localisation Le SRO (Sous-Répartiteur Optique) est un point de mutualisation passif installé en armoire de rue, en chambre télécom ou en immeuble. Il constitue le premier niveau de distribution du signal depuis le NRO. Fonction de répartition Le SRO héberge les splitters optiques (coupleurs passifs) qui divisent le signal provenant d'une fibre du NRO vers plusieurs fibres en direction des abonnés. Un splitter typique peut avoir un ratio de 1:8, 1:16, 1:32 ou 1:64. Architecture de mutualisation En France, le SRO constitue le point de mutualisation où plusieurs opérateurs peuvent se raccorder pour desservir les mêmes abonnés. Cette mutualisation répond à une obligation réglementaire dans les zones très denses et permet la concurrence. Dimensionnement Le nombre de ports disponibles au SRO détermine le nombre maximum d'abonnés raccordables dans la zone. Une planification rigoureuse est nécessaire pour anticiper les besoins futurs. Le PCO/PBO - Point de connexion optique (point de branchement) Définition et implantation Le PCO (Point de Connexion Optique) appelé aussi PBO (Point de Branchement Optique), est un boîtier situé à proximité immédiate des logements à desservir. On le trouve généralement en pied d'immeuble, sur poteau, en façade ou en chambre de tirage. Fonction de distribution terminale Le PCO assure la transition entre le réseau de distribution (depuis le SRO) et les câbles de branchement individuels vers chaque logement. Il permet de connecter rapidement un nouvel abonné sans intervention sur le réseau principal. Équipements Le PCO contient des connecteurs optiques (SC/APC ou LC/APC selon les opérateurs) et permet la gestion des jarretières de raccordement. Il est étanche et sécurisé pour une installation en extérieur. La PTO - Prise terminale optique Définition et installation La PTO (Prise Terminale Optique) est le point d'aboutissement de la fibre optique à l'intérieur du logement de l'abonné. Elle marque la limite de responsabilité entre le réseau de l'opérateur et l'installation intérieure du client. Caractéristiques Installation murale similaire à une prise électrique Équipée d'un connecteur SC/APC femelle Protégée par un cache de sécurité Point de démarcation légal du réseau Normes d'installation La PTO doit être installée conformément aux normes NFC 15-100 et doit être accessible, idéalement dans le tableau de communication (GTL - Gaine Technique Logement) ou à proximité. L'ONT/ONU - Optical network terminal/unit L'ONT/ONU - Optical network terminal/unit - Boitier séparé ou intégré dans la Livebox Définition et fonction L'ONT (Optical Network Terminal) ou ONU (Optical Network Unit) est l'équipement terminal actif qui convertit le signal optique en signal électrique exploitable. Dans la plupart des cas en France, l'ONT est intégré directement dans la box Internet fournie par l'opérateur (Livebox, Freebox, Bbox, etc.). Rôle de conversion L'ONT assure plusieurs fonctions critiques : Conversion opto-électronique : Transformation du signal lumineux en signal électrique Authentification : Identification sur le réseau de l'opérateur Gestion des services : Fourniture d'Internet, téléphonie, télévision Interface utilisateur : Ports Ethernet, WiFi, téléphone pour connecter les équipements du client Technologie PON L'ONT communique avec l'OLT selon le protocole GPON ou XGS-PON, permettant des débits théoriques jusqu'à 10 Gbit/s en symétrique avec XGS-PON. Chaîne de transmission complète Le parcours du signal optique s'effectue selon le schéma suivant : OLT (NRO) → Fibre de transport → SRO (Splitters) → Fibre de distribution → PCO → Câble de branchement → PTO → Jarretière optique → ONT (Box) → Équipements de l'abonné Chaque segment de cette chaîne doit respecter des budgets optiques précis (atténuation maximale) pour garantir la qualité du signal et les débits contractuels. Lecture et interprétation des paramètres ONT (Exemple Livebox Orange) Accès aux informations techniques Sur une Livebox Orange, les paramètres de l'ONT sont accessibles via l'interface d'administration dans les Informations Système dans l'onglet ONT (généralement http://192.168.1.1). Voici l'interprétation des principaux paramètres : Statut de la connexion Valeur : true = Connexion active et fonctionnelle Indique que l'ONT est correctement enregistré sur l'OLT Statut de l'ONT O5_Operation = État opérationnel normal États possibles : O1 (Initial), O2 (Standby), O3 (Serial Number), O4 (Ranging), O5 (Operationel), O6 (POPUP), O7 (Emergency Stop) Max Bit Rate Supported 10000 Mbps = Débit maximal supporté (10 Gbit/s) Indique que l'ONT supporte le XGS-PON ou est compatible 10G Signal RxPower (Puissance de réception) -21.426 dBm = Niveau de signal reçu depuis l'OLT Plage acceptable : -8 dBm à -28 dBm Valeurs au-delà de -28 dBm indiquent une atténuation excessive Valeurs au-dessus de -8 dBm peuvent saturer le récepteur Signal TxPower (Puissance d'émission) 3.755 dBm = Niveau de signal émis vers l'OLT Plage typique : 0 à +5 dBm Indicateur de bon fonctionnement du laser de l'ONT Temperature 66°C = Température de fonctionnement Plage acceptable : 0°C à 70°C Une température élevée peut indiquer un problème de ventilation Bias (Courant de polarisation du laser) 1.8 mA = Courant d'alimentation du laser Valeur stable indiquant un fonctionnement normal Serial Number SMBS06051738 = Numéro de série unique de l'ONT Utilisé pour l'identification et l'authentification sur le réseau 8.9 Hardware Version SMBSSGLB6110 = Version matérielle du module ONT 8.10 Equipment ID SagemcomFast5670EOFR = Modèle de la Livebox Identification du matériel pour la gestion du parc Vendor ID SMBS = Identifiant du fabricant (Sagemcom) Voltage 3.1V = Tension d'alimentation de l'ONT Plage normale : 3.0V à 3.5V Versions logicielles Indiquent les firmwares installés et la version active Importantes pour la compatibilité et les mises à jour FAQ - Les 10 questions essentielles sur la fibre FTTH Qu'est-ce que la FTTH et quels sont ses avantages ? La FTTH signifie "Fiber To The Home" (Fibre jusqu'à l'Abonné). C'est une technologie qui amène la fibre optique directement jusqu'à votre domicile, offrant des débits très élevés (de 500 Mbps à 10 Gbps). Avantages principaux : Débits jusqu'à 100 fois supérieurs à l'ADSL Latence très faible (< 10 ms) idéale pour le gaming et visioconférence Débit symétrique possible (upload = download) Pas de dégradation du signal avec la distance Immunité aux interférences électromagnétiques Technologie évolutive pour les besoins futurs Comment fonctionne l'architecture d'un réseau FTTH ? Le réseau FTTH se compose de 5 équipements principaux reliés par fibre optique : OLT (NRO) : Équipement central de l'opérateur qui génère le signal optique SRO : Point de mutualisation avec des splitters qui divisent le signal vers plusieurs abonnés PCO : Point de branchement situé près de votre logement (pied d'immeuble, poteau) PTO : Prise terminale optique murale à l'intérieur de votre logement ONT (Box) : Équipement qui convertit le signal optique en signal électrique pour vos appareils Le signal parcourt : OLT → SRO → PCO → PTO → ONT → vos équipements Que dois-je préparer AVANT l'arrivée du technicien ? Vérifications techniques : Repérer l'emplacement du PCO (pied d'immeuble, poteau, façade) Vérifier l'existence de gaines techniques ou fourreaux entre le PCO et votre logement Identifier la présence d'une GTL (Gaine Technique Logement) ou d'une gaine ICTA Vérifier la présence d'une prise électrique fonctionnelle à proximité de l'emplacement souhaité Préparation du logement : Dégager complètement la zone où sera installée la PTO (2 mètres autour) Retirer les meubles, tableaux, objets fragiles de la zone de travail Vérifier l'accès au bâtiment (codes, clés des locaux techniques) Prévoir 2 à 4 heures de disponibilité obligatoire Mettre les animaux en sécurité dans une pièce fermée Où dois-je installer ma PTO (prise fibre) ? Emplacements recommandés : Dans ou près de la GTL (Gaine Technique Logement) - IDÉAL À proximité du tableau électrique Dans l'entrée, le séjour ou le bureau selon vos besoins À 15-30 cm du sol (hauteur standard des prises électriques) À moins de 2-3 mètres d'une prise électrique pour alimenter la box À éviter absolument : Salle de bain, buanderie (zones humides) Près d'une source de chaleur (radiateur, cheminée) Derrière un meuble fixe ou difficile d'accès En plein soleil direct 💡 Important : Réfléchissez aussi à l'emplacement de votre box Internet pour une bonne couverture WiFi (position centrale idéale). Comment interpréter les paramètres de mon ONT (box) ? Les paramètres essentiels à surveiller (accessibles sur http://192.168.1.1 pour Orange) : RxPower (Puissance de réception) : Plage acceptable : -8 dBm à -28 dBm Plage optimale : -15 dBm à -25 dBm Si < -28 dBm : signal trop faible → problème à signaler Si > -8 dBm : risque de saturation du récepteur Statut de l'ONT : O5_Operation = Fonctionnement normal ✓ Autre statut = Problème de connexion Température : Plage acceptable : 0°C à 70°C Si > 70°C : problème de ventilation, éloigner des sources de chaleur TxPower (Puissance d'émission) : Plage normale : 0 à +5 dBm Indicateur du bon fonctionnement du laser de votre box Combien de temps dure l'installation et que fait le technicien ? La durée d'intervention est généralement de 2 à 4 heures selon la complexité. Étapes de l'intervention : 1. Visite des lieux (15 min) : Le technicien inspecte, valide le parcours et l'emplacement de la PTO avec vous 2. Tirage de la fibre (30 min à 2h) : Raccordement au PCO, tirage jusqu'à votre logement via des gaines existantes ou installation de goulottes apparentes 3. Installation de la PTO (15-30 min) : Perçage, fixation de la prise murale, raccordement de la fibre 4. Installation de la box (15-30 min) : Connexion de la jarretière optique PTO-box, mise sous tension, initialisation 5. Tests et formation (15-30 min) : Vérification du signal, test de débit, explication du fonctionnement, remise des documents 💡 Votre rôle : Rester présent et disponible pendant toute la durée, valider les choix d'emplacement, poser vos questions. Que faire si ma connexion ne fonctionne pas correctement ? Réponse : Procédure de diagnostic : 1. Vérifications immédiates : Voyants de la box (noter les couleurs et comportements) Vérifier que la jarretière optique est bien branchée (PTO et box) Vérifier l'alimentation électrique Redémarrer la box (débrancher et attendre 30 secondes) 2. Consulter les paramètres de l'ONT : Accéder à l'interface web de la box (http://192.168.1.1) Vérifier le RxPower (doit être entre -8 et -28 dBm) Vérifier le statut ONT (doit être O5_Operation) Vérifier la température (< 70°C) 3. Test de débit : Connecter un ordinateur en Ethernet directement sur un port RJ45 de la box (pas en WiFi) Utiliser speedtest.net, fast.com ou nperf.com Comparer avec votre offre (tolérance 80% en Ethernet) 4. Problèmes courants et solutions : Si le problème persiste : Contacter le support technique avec vos observations et vos mesures. Puis-je débrancher ou déplacer ma box après l'installation ? Débrancher la jarretière optique (câble PTO-box) : Techniquement possible mais fortement déconseillé Risque de salir les connecteurs et dégrader le signal À faire uniquement en cas de panne ou déménagement Si nécessaire : manipuler délicatement, nettoyer avec une lingette optique avant reconnexion Déplacer la box : OUI, dans la limite de la longueur de la jarretière (1 à 3 mètres) Règles impératives : Ne pas débrancher la jarretière si possible Ne jamais plier la fibre (rayon de courbure minimum 3 cm) Ne pas tirer ou tendre excessivement Ne pas coincer la fibre (porte, fenêtre, meuble) Assurer une bonne ventilation de la box Conseils : Si vous devez déplacer la box, envisagez un câble Ethernet plus long, plutôt que de bouger la jarretière optique Pour une meilleure couverture WiFi, positionnez la box en hauteur et au centre du logement Conclusion L'architecture FTTH représente une infrastructure complexe mais robuste, permettant de délivrer des débits symétriques très élevés sur de longues distances. La maîtrise de chaque composant (OLT, SRO, PCO, PTO, ONT) et la compréhension des paramètres de supervision sont essentiels pour garantir une qualité de service optimale. Les techniciens doivent porter une attention particulière aux mesures optiques, à la propreté des connexions et au respect des normes d'installation. La supervision régulière des paramètres ONT permet d'anticiper les problèmes et de maintenir un réseau performant dans la durée. Avec l'évolution vers le XGS-PON et les débits multi-gigabit, la fibre optique reste la technologie d'avenir pour les réseaux d'accès, nécessitant des compétences techniques solides et une formation continue des équipes de déploiement. Source: https://networkpulse.fr/deploiement-et-architecture-du-reseau-ftth-en-france/ -

-

IA Mon nouvel ami qui sait tout sur tout #chatGPT - Korben.info

Ldfa a répondu à un(e) sujet de Ldfa dans Mon Wallabag

My name is TRUMP, Donald TRUMP !!! -