Rechercher dans la communauté

Affichage des résultats pour les étiquettes 'Linux'.

33 résultats trouvés

-

IT-Connect Publié le 6 mai 2026 Par Florian BURNEL it-connect.fr Environ 14 minutes de lecture Maîtriser le filtrage réseau de votre hyperviseur constitue la première ligne de défense de vos environnements virtualisés. Dans le contexte de Proxmox VE, les administrateurs peuvent compter sur un pare-feu intégré. Il présente l'avantage de permettre une gestion des flux à plusieurs niveaux : datacenter, nœud et ressources (machine virtuelle ou conteneur). Comment s'effectue la configuration du firewall Proxmox VE ? C'est ce que nous verrons dans la suite de cet article. Retrouvez les autres tutoriels Proxmox VE : Débuter avec Proxmox VE : installation et premiers pas La configuration du réseau avec Proxmox VE : le guide pour bien débuter Proxmox VE : bien débuter avec les conteneurs LXC Le fonctionnement du pare-feu Proxmox VE Le pare-feu intégré à Proxmox VE (nommé pve-firewall) est une solution de filtrage basée sur les fonctionnalités natives du noyau Linux, notamment iptables (le module pour nftables est en préversion). Ici, il n'est pas question de déployer une appliance virtuelle assumant la fonctionnalité de firewall. En effet, le pare-feu Proxmox s'exécute directement sur chaque nœud (serveur physique) de l'environnement virtualisé, que ce soit un hôte autonome ou un cluster. Le système de pare-feu de Proxmox VE est hiérarchique et se divise en trois zones distinctes : Le Datacenter (idéal pour un cluster) : définit les règles globales qui s'appliquent à l'ensemble des nœuds de l'infrastructure. C'est ici que l'on crée certains éléments comme les groupes de sécurité (appelés fréquemment Security Groups), les alias d'adresses IP et les listes (IPSets). Le nœud (hôte physique) : les règles spécifiques au serveur Proxmox lui-même, notamment pour protéger ses interfaces d'administration (WebUI, SSH). La machine virtuelle (VM) ou le conteneur (LXC) : les règles de filtrage spécifiques à une seule ressource et adaptées aux services hébergés par cette même ressource (serveur web, base de données, etc.). À ce niveau, les règles du nœud et du datacenter ne sont pas héritées. Grâce à ces différents niveaux, les règles peuvent être appliquées au plus près de la source et de la destination du trafic en fonction des besoins. Surtout, Proxmox VE est en mesure de bloquer les flux avant même qu'ils atteignent la ressource, ce qui est avantageux. Note : Proxmox VE applique les règles de pare-feu sur les nœuds dans un ordre hiérarchique logique, en allant du périmètre le plus éloigné à celui le plus proche. Ce qui donne : Datacenter > Nœud. Activer le pare-feu sur Proxmox VE L'activation du pare-feu dans Proxmox VE s'effectue en plusieurs étapes, et surtout, à tous les niveaux. Si le pare-feu n'est pas activé au plus haut niveau, les configurations inférieures ne seront pas appliquées. Autrement dit, pour appliquer des règles au niveau d'une machine virtuelle, vous devez activer le pare-feu au niveau du datacenter, du nœud, puis de la VM. Attention, si vous activez le pare-feu sans créer de règles en amont, vous perdrez la main sur votre serveur Proxmox VE ! En effet, la politique par défaut consiste à refuser tout le trafic entrant. Avant d'activer le firewall comme spécifié ci-dessous, vous devez donc commencer par le configurer. Activation globale (Datacenter) C'est le prérequis. Dans l'interface web, sélectionnez "Datacenter" dans le menu de gauche, puis naviguez vers "Firewall" > "Options". Modifiez l'option "Firewall" de "No" à "Yes", comme sur l'image ci-dessous. Sans cette action, le service associé au pare-feu reste inactif. Par défaut, la politique d'entrée (Input Policy) est définie sur "DROP", ce qui signifie que tout trafic entrant non explicitement autorisé par une règle est bloqué. La politique de sortie (Output Policy) est généralement sur "ACCEPT", ce qui veut dire que tous les flux sortants sont autorisés. Ce type de manipulation peut être effectué également en ligne de commandes : pvesh set /nodes/pve-01/firewall/options -enable 0 D'une manière générale, toute la configuration peut être effectuée via la ligne de commande et l'édition de fichiers. Activation sur un nœud (hôte) Même après l'activation au niveau Datacenter, chaque nœud dispose de son propre interrupteur. Sélectionnez votre nœud (par exemple "pve-01"), allez dans "Firewall" > "Options" et assurez-vous que le paramètre "Firewall" est bien activé, comme pour le niveau Datacenter. Activation sur une VM ou un conteneur Pour filtrer les flux entrants et sortants au niveau d'une machine virtuelle (ou d'un conteneur), deux conditions doivent être remplies : Dans la section "Firewall" > "Options" de la VM, le pare-feu doit être sur "Yes". Au niveau de la carte réseau virtuelle (Hardware > Network Device), la case "Firewall" doit être cochée dans les paramètres de l'interface réseau. Si cette case est décochée, la carte réseau ignore totalement les règles de filtrage, même si le pare-feu de la VM est activé. Voici l'option à laquelle je fais référence au niveau des paramètres de l'interface réseau de la VM : L'utilisation combinée des trois niveaux offre une grande flexibilité et s'inscrit dans le principe de défense en profondeur. Les règles définies au niveau du Datacenter sont évaluées avant celles du nœud. Cela permet de créer une règle globale (par exemple : bloquer une adresse IP malveillante sur l'ensemble du cluster) qui sera héritée et appliquée partout, tout en laissant la liberté à chaque nœud ou VM d'avoir ses propres règles locales. Mise en pratique avec un cas concret Afin de bien comprendre la mécanique de ce pare-feu, configurons deux scénarios fréquents. Scénario 1 : sécurisation de l'hôte Proxmox L'objectif est de protéger l'hyperviseur lui-même. Vous pourriez alors imaginer créer un ensemble de règles de pare-feu pour limiter l'accès à l'interface d'administration web (port 8006) et au SSH (port 22), uniquement depuis une ou plusieurs adresses IP de confiance. Allez sur le nœud ciblé, puis "Firewall" > "Add" pour créer une règle. Direction : in (flux entrant) Action : ACCEPT (accepter) Interface : ici je précise vmbr0, à savoir le bridge par défaut sur Proxmox VE. Selon votre infrastructure, il peut s'avérer utile de spécifier un autre nom d'interface. Source : si vous mettez rien, tout le monde sera autorisé, donc vous pouvez restreindre à un hôte ou à une machine si besoin. Macro : sélectionnez SSH. Les macros remplissent automatiquement le protocole et le port de destination, ce sont comme des règles prédéfinies pour les services les plus communs. La liste des macros est disponible sur cette page. Ajoutez un commentaire (important pour documenter). Activez la règle en cochant l'option "Enable". Ajoutez la règle avec le bouton "Add". Pour autoriser également l'accès sur l'interface Web, répétez l'opération en choisissant cette fois-ci le port de destination manuel 8006 (avec le protocole TCP). Voici un exemple : En définissant ces règles et en laissant la politique par défaut sur DROP, toute autre adresse IP tentant de se connecter à l'interface de gestion sera rejetée. D'ailleurs, tous les autres flux à destination de votre hôte seront rejetés d'une façon générale (mais pas à destination des VM). Je vous encourage à peaufiner cette liste de règles, notamment si vous êtes en cluster, car il y a d'autres ports à autoriser. La liste des différents services et des ports associés est disponible dans la documentation de Proxmox VE. Pour les règles spécifiques aux clusters, vous pouvez ajuster la source pour autoriser uniquement le trafic entre les nœuds. Interface Web : 8006 (TCP) Console Web VNC : 5900-5999 (TCP, WebSocket) SPICE proxy : 3128 (TCP) SSH: 22 (TCP) rpcbind : 111 (UDP) sendmail : 25 (TCP, outgoing) Trafic Corosync pour le cluster : 5405-5412 UDP Live Migration : 60000-60050 (TCP) Scénario 2 : sécurisation d'une machine virtuelle Prenons une VM (ID 100) hébergeant un serveur web Linux. Nous voulons rendre les sites accessibles en HTTP/HTTPS. Voici comment procéder. Allez sur la VM 100, "Firewall" > "Add". Créons la règle Web : Direction : in Action : ACCEPT Macro : Sélectionnez la macro Web. Elle permet d'autoriser les ports 80 et 443 en TCP, ce qui correspond à notre besoin. Source : laissez la source vide (ce qui équivaut à n'importe quelle adresse, soit 0.0.0.0/0). Créez la règle, mais pensez à l'activer et à ajouter un commentaire. Ce qui donne : Vous remarquerez que nous n'avons pas spécifié de nom d'interface : ce n'est pas nécessaire lorsque la règle s'applique à une machine virtuelle. Par contre, veillez à activer le pare-feu au niveau de la VM et de l'interface réseau de celle-ci. Désormais, cette machine est joignable sur deux ports : 80 et 443. Tous les autres flux sont bloqués (souvenez-vous de la politique par défaut appliquée aux flux entrants). Si vous souhaitez vous connecter en SSH à cette VM, créez une seconde règle. Dans ce cas, il est judicieux de limiter les sources (un sous-réseau bien spécifique, l'IP d'un poste d'administration, etc.). Voici un exemple : Voilà, vous savez désormais comment créer des règles de pare-feu sur votre serveur Proxmox VE. Mais, pour être efficace dans l'administration et la maintenance de ces règles de pare-feu, il me semble judicieux de s'intéresser à certaines fonctionnalités proposées par PVE. Note : appliquez le principe du moindre privilège lorsque vous réfléchirez à votre règle. Security Groups du firewall Proxmox VE Proxmox VE permet de créer des Security Groups au niveau du Datacenter. Un Security Group dans Proxmox VE fonctionne comme un modèle de règles de pare-feu centralisé et réutilisable. Imaginez que vous administrez une dizaine de serveurs web : au lieu de configurer manuellement l'ouverture des ports 80 (HTTP) et 443 (HTTPS) sur chaque machine virtuelle de façon isolée, vous créez un unique groupe nommé "Web_Rules" au niveau global (Datacenter). Ensuite, vous n'avez plus qu'à "insérer" ce groupe dans les paramètres de pare-feu de chaque machine concernée. L'avantage principal est la simplification de la maintenance : si vous devez un jour autoriser un nouveau port pour vos applications web, il vous suffit de modifier ce Security Group une seule fois pour que la mise à jour se déploie instantanément sur l'ensemble des serveurs virtuels qui y sont liés. Pour en créer un nouveau : Datacenter > Firewall > Security Group > Create. Donnez-lui un nom, par exemple "Web_Rules". Puis, sélectionnez-le sur la gauche pour ensuite ajouter une règle de pare-feu dans ce groupe. Ici, on crée une règle toute simple pour autoriser les flux entrants HTTP/HTTPS en sélectionnant la macro Web. Quand c'est fait, il ne reste plus qu'à appliquer ce Security Group à une ressource. Pour cela, vous n'avez qu'à sélectionner la VM, à cliquer sur l'onglet "Firewall" puis choisissez "Insert: Security Group". Ici, vous n'aurez qu'à le sélectionner pour créer une règle qui va reprendre toutes celles intégrées au Security Group. Pensez à cocher l'option "Enable" également. Si par la suite vous modifiez les règles de ce Security Group, les ressources qui l'utilisent hériteront de cette modification. Ainsi, vous pouvez rendre vos configurations plus facilement homogènes. Les alias avec le firewall Proxmox VE Dans le pare-feu de Proxmox VE, les Alias et les IPSets sont deux autres outils conçus pour simplifier la gestion de vos adresses réseau, mais ils répondent à des besoins différents. Un Alias fonctionne comme un contact dans votre répertoire téléphonique. Au lieu de saisir manuellement une adresse IP (comme 192.168.1.50) dans vos règles de pare-feu, vous lui donnez un nom user-friendly, par exemple "PC_Florian". Un Alias ne peut contenir qu'une seule adresse IP ou un seul sous-réseau. Vous pouvez donc aussi créer un alias pour disposer d'un objet faisant référence à un sous-réseau (un VLAN, par exemple). Son but premier est d'améliorer la lisibilité et la maintenance : si l'adresse IP de votre administrateur change un jour, il vous suffit de mettre à jour l'Alias à un seul endroit pour que toutes les règles qui l'utilisent soient automatiquement actualisées. Pour créer un alias : Datacenter > Firewall > Alias > Add. Vous devez nommer l'alias et spécifier l'adresse IP correspondantes (/32 pour un hôte unique). Par la suite, quand vous créez une règle de pare-feu, vous pouvez sélectionner cet alias en tant que source ou destination. Par exemple : Les IPSet avec le firewall Proxmox VE Un IPSet (ensemble d'IP), en revanche, s'apparente à une liste de diffusion ou un groupe de contacts. Il est conçu pour regrouper plusieurs adresses IP, de multiples sous-réseaux, ou même des Alias sous une étiquette unique (par exemple "Postes_administration" ou "Blacklist_IP"). Son atout : le pare-feu utilise une structure de données très optimisée dans le noyau Linux (table de hachage). Ainsi, vérifier si un trafic entrant correspond à l'une des 10 000 adresses IP contenues dans un IPSet se fait de manière quasi instantanée, ce qui serait impossible si vous deviez créer 10 000 règles de pare-feu individuelles. Vous pourrez ensuite associer l'IPSet à une règle de firewall, sur le même principe que l'affectation d'un alias. En résumé : Utilisez un Alias pour identifier une ressource unique dont l'IP pourrait changer à l'avenir (vous modifierez l'Alias et toutes les règles liées seront mises à jour). Utilisez un IPSet dès que vous devez appliquer une politique réseau identique à un groupe, une liste ou une plage hétérogène de plusieurs machines. La journalisation du firewall La journalisation (logging) est utile pour le débogage et l'audit de sécurité. Sur chaque règle, vous avez la possibilité de définir un niveau de log (info, warning, err, etc.). Il est judicieux d'activer les logs sur les règles de type "DROP" pour identifier d'éventuelles problèmes. Attention toutefois à ne pas journaliser l'intégralité du trafic valide au risque de saturer l'espace disque de vos nœuds. Le niveau de log par défaut est déterminé au niveau de chaque noeud et de chaque ressource (VM/CT). Vous pouvez définir un niveau de log différents pour les flux entrants et les flux sortants. Ensuite, au niveau de chaque règle, vous pouvez aussi faire un choix spécifique. Vous devez cocher la case "Advanced" pour faire apparaître l'option nommée "Log level". Pour consulter l'activité du pare-feu d'une ressource spécifique (ici, la machine virtuelle 100 (Debian-12)) : Sélectionnez la ressource concernée dans l'arborescence de gauche. Déroulez le menu "Firewall". Cliquez sur la sous-section "Log" En haut de l'écran, Proxmox propose deux boutons pour gérer l'affichage des logs : Live Mode : C'est le mode actif par défaut. Il affiche les flux en temps réel. Dès qu'un nouveau paquet est traité et journalisé par le pare-feu, la ligne apparaît instantanément à l'écran. Select Timespan : ce mode permet de filtrer les logs sur une période précise en utilisant les champs Since (Depuis) et Until (Jusqu'à). L'écran principal affiche les logs bruts générés par le composant du pare-feu (iptables ou nftables). Prenons le temps de décomposer les informations essentielles que contient une ligne : 100 6 tap100i0-IN 06/May/2026:10:56:25 +0200 ACCEPT: IN=fwbr100i0 [...] SRC=192.168.1.73 DST=192.168.110.12 Voici quelques explications : 100 : l'identifiant (ID) de la machine virtuelle concernée. tap100i0-IN : indique l'interface virtuelle impliquée (l'interface réseau 0 de la VM 100) et la direction du trafic. Ici IN signifie qu'il s'agit d'une règle de trafic "Entrant" (vers la VM). 06/May/2026:10:56:25 +0200 : l'horodatage exact de l'événement. ACCEPT : c'est l'action prise par le pare-feu. Ici, le trafic a été autorisé. (Vous pourriez y voir DROP pour un trafic bloqué silencieusement ou REJECT pour un trafic rejeté). IN=... OUT=... PHYSIN=... : ces champs décrivent le parcours complexe du paquet à travers les différents ponts (bridges) virtuels internes de Proxmox (fwbr, fwln) avant d'atteindre l'interface de la VM (tap). MAC=... : l'adresse MAC source et destination. SRC=192.168.1.73 : l'adresse IP source (l'ordinateur ou le serveur qui a initié la connexion). DST=192.168.110.12 : l'adresse IP de destination (en principe, vous verrez ici l'adresse IP de votre machine virtuelle). Forcer la désactivation du firewall Proxmox VE En cas de mauvaise manipulation vous bloquant l'accès à l'interface web (WebUI), il est nécessaire d'intervenir directement en ligne de commande depuis la console locale du serveur (via un KVM, un accès console physique...). Pour désactiver le pare-feu au niveau du Datacenter, éditez le fichier de configuration principal : nano /etc/pve/firewall/cluster.fw Au sein de ce fichier, localisez la section [OPTIONS] située au tout début. Modifiez la directive enable: 1 en remplaçant le 1 par un 0 (enable: 0), puis sauvegardez le fichier (avec Ctrl+O puis Ctrl+X sous nano). Proxmox détectera automatiquement ce changement et désactivera le pare-feu, vous rendant ainsi l'accès ! L'autre solution consiste à stopper temporairement le pare-feu via l'exécution de cette commande : pve-firewall stop Cette commande coupe le processus de pare-feu sur le nœud actif. C'est une solution de secours pratique pour récupérer la main le temps de corriger la règle fautive - ou manquante - dans l'interface graphique. Une fois votre configuration réparée, n'oubliez pas de relancer le service avec la commande pve-firewall start ou de réactiver le pare-feu depuis l'interface web. Conclusion Le pare-feu intégré de Proxmox VE est une solution complète, performante et distribuée, adaptée à la protection des environnements virtualisés. Sa gestion à trois niveaux (Datacenter, Nœud, VM) permet de créer des politiques de sécurité fines, granulaires et facilement maintenables (souvenez-vous des IPSet, Alias et Security Group), que vous gériez un serveur isolé ou un cluster. En appliquant une politique de blocage par défaut, en utilisant les groupes de sécurité et les macros, et en ciblant les flux nécessaires au bon fonctionnement de vos services, vous disposez d'un filtrage cohérent sans toucher au pare-feu de l'OS de vos VM ou conteneurs. Ingénieur système et réseau, cofondateur d'IT-Connect et Microsoft MVP "Cloud and Datacenter Management". Je souhaite partager mon expérience et mes découvertes au travers de mes articles. Généraliste avec une attirance particulière pour les solutions Microsoft et le scripting. Bonne lecture. Afficher l’article complet

-

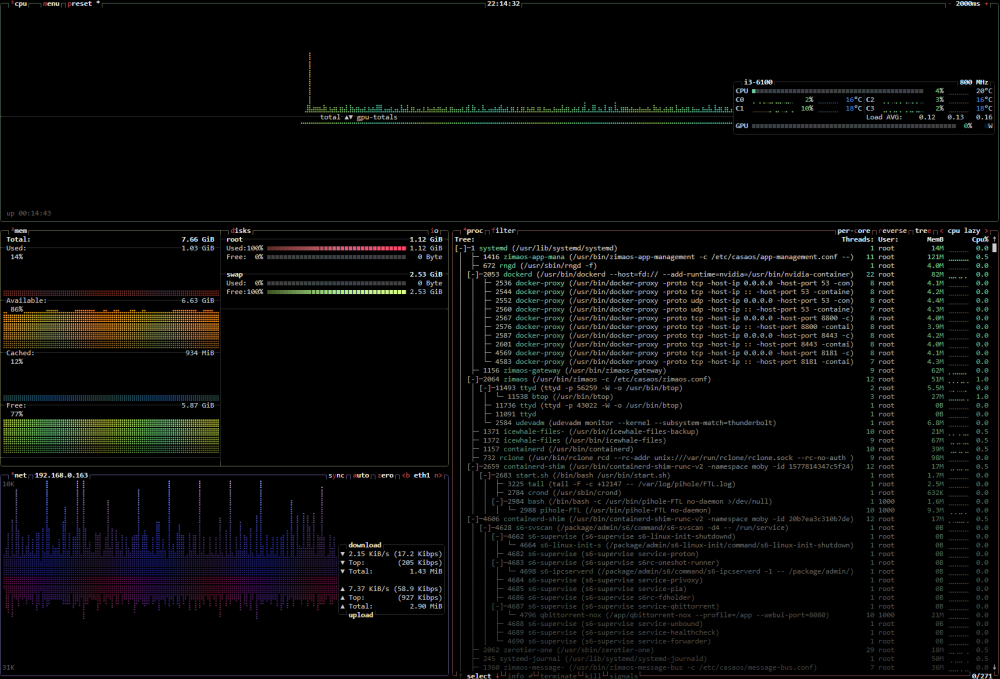

Je suis enfin arrivé à jouer à mes jeux favoris sous Linux, et sans trop de difficulté finalement... J'ai installé la distribution Linux Pop!_OS qui est prête pour jouer sous Linux, en suivant ce tuto : Après l'installation et le redémarrage, ainsi que les quelques outils supplémentaires indiqués dans la vidéo précédente, voici la copie d'écran réalisée en jouant à Trackmania Stadium. Le jeu est très fluide, comme sous Windows, c'est parfait.

-

Proxmox PegaProx - Un dashboard pour les gouverner tous - Korben

Ldfa a posté un sujet dans Mon Wallabag

Korben Publié le 18 avril 2026 Par Korben, Manuel Dorne korben.info Environ 2 minutes de lecture L'interface web de Proxmox (l'outil de virtualisation que tout bon homelabber connaît), c'est bien... pour UN serveur. Dès que vous commencez à empiler les nodes et les clusters, ça devient vite le bazar avec 15 onglets ouverts. PegaProx , c'est tout simplement un dashboard open source qui unifie tout ça dans un seul écran. Et vous allez voir, le truc cool, c'est que ça gère aussi les clusters XCP-ng ! L'interface de PegaProx - une vue unifiée de tous vos clusters Proxmox et XCP-ng Concrètement, vous branchez tous vos hyperviseurs sur cette interface web (port 5000) et hop, vous avez la vue complète. VMs, conteneurs, métriques de perf... tout remonte en temps réel via Server-Sent Events. Du coup, plus besoin de jongler entre les interfaces de chaque node pour savoir quel serveur rame. Côté fonctionnalités, accrochez-vous les amis parce que pour une beta, c'est déjà bien garni ! Migration live de VMs entre nodes, gestion du stockage Ceph, consoles navigateur via noVNC et xterm.js, et même de la migration cross-hypervisor entre ESXi, Proxmox VE 8.0 et XCP-ng (encore expérimental côté ESXi, mais ça avance). Y'a aussi des règles d'affinité pour placer vos VMs, du rolling update avec évacuation automatique, et des alertes sur les seuils CPU/RAM/disque. Pour une beta, c'est assez dingue ce qu'ils ont déjà mis dedans. Côté sécurité, c'est pas en reste non plus. Y'a du RBAC avec 3 rôles (Admin, Operator, Viewer, pas plus pas moins), du TOTP pour le 2FA, de l'intégration LDAP et OIDC compatible Active Directory, Entra ID, Keycloak ou Google Workspace, du chiffrement AES-256-GCM pour stocker les credentials en base, et même du scan de CVE via debsecan. Autrement dit, ils ont pensé aux admins sérieux. Pour ceux qui ont déjà configuré un provider OIDC sur leur homelab , ça se branche directement. Pour l'installer, le plus simple c'est Docker. Un docker compose up -d, 30 secondes d'attente, et c'est plié. Mais y'a aussi un script de déploiement automatique, un repo APT communautaire maintenu par gyptazy, ou le classique git clone + pip pour les puristes. Une fois lancé, vous pointez votre navigateur sur https://votre-ip:5000, et un assistant vous accueille avec les identifiants par défaut (pegaprox/admin, à changer immédiatement bien sûr). L'interface est dispo en 5 langues : français, anglais, allemand, espagnol et portugais. D'ailleurs, si vous utilisez déjà ProxMenux pour administrer votre Proxmox en terminal, les deux sont en fait complémentaires. Disons que ProxMenux couvre l'admin système en ligne de commande, alors que le dashboard apporte la vue unifiée multi-clusters en web. Initialement j'aurais dit que c'était redondant, mais non, ça se marie plutôt bien. Et y'a même un système de plugins avec un portail client pour vos utilisateurs et une page de statut publique à la StatusGator. Attention c'est comme je vous le disais, encore une beta. L'OIDC avec Authentik par exemple, ça fonctionne pour le login mais les groupes ne remontent pas encore correctement (retour d'un lecteur qui l'utilise au quotidien). Par contre si vous n'avez qu'un seul serveur Proxmox, honnêtement c'est un peu overkill, l'interface native suffit largement. Quelques glitchs traînent ici ou là, et l'API Token pour se connecter à la place de root n'est pas super bien documenté. Mais le projet avance vite donc c'est plutôt bon signe ! Bref, ça promet pas mal. Merci à Maxime pour la découverte ! Afficher l’article complet -

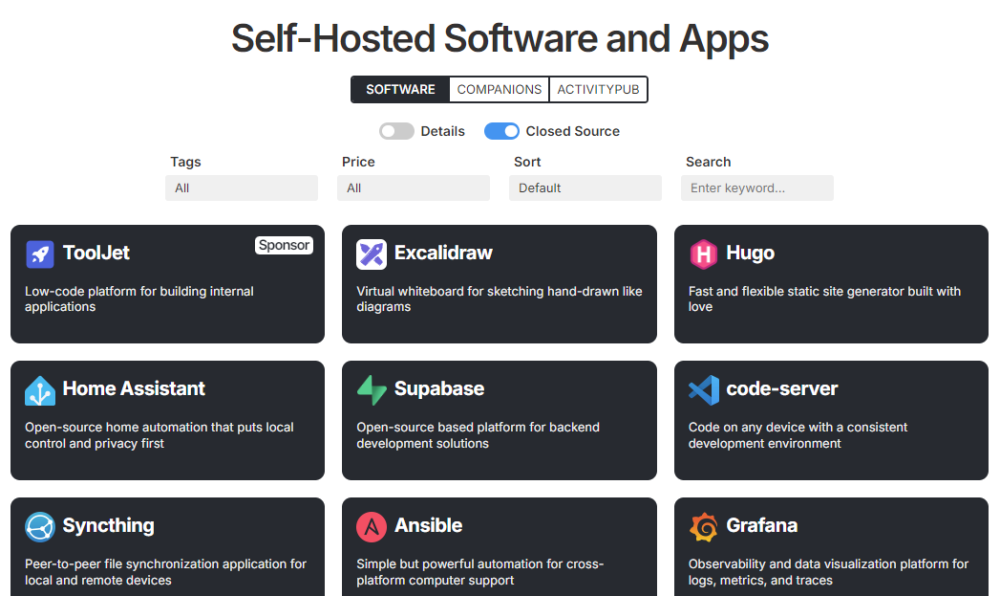

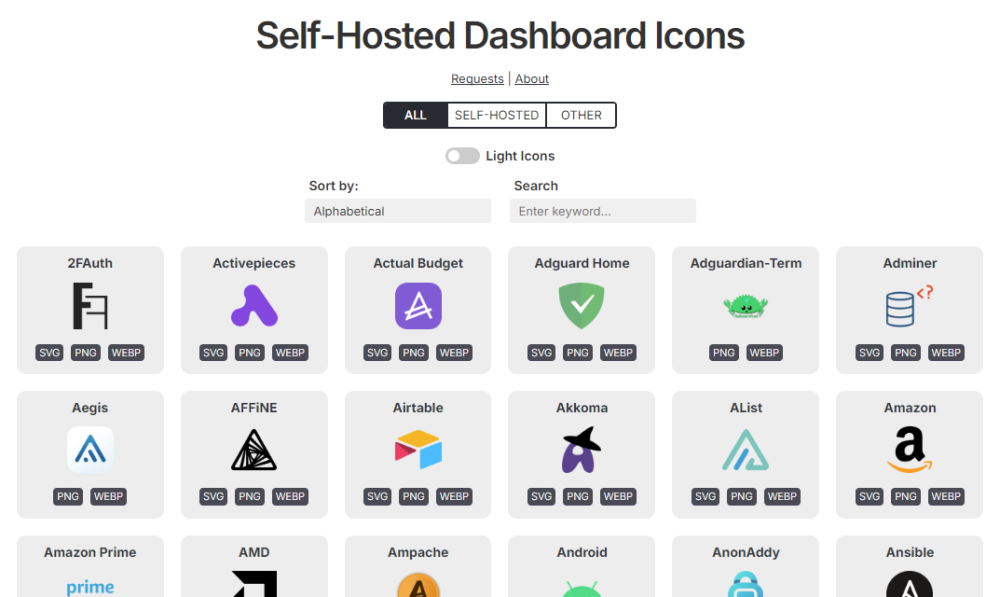

Korben Publié le 17 avril 2026 Par Korben, Manuel Dorne korben.info Environ 3 minutes de lecture Quand on fait du self-hosting, y'a toujours ce moment où on se dit "tiens, y'aurait pas un truc open source pour ça". Tenez par exemple, là je suis en train de chercher un machin open source pour un mariage qui permet aux invités de balancer leurs photos sur un serveur en scannant un QR Code. Et donc je me retrouve à scroller awesome-selfhosted sur GitHub, qui est une liste fleuve de +1500 projets, en essayant de deviner lesquels sont encore vivants. Et c'est exactement ce problème qu'a voulu résoudre Ethan Sholly en lançant selfh.st/apps en 2024. En gros, c'est un annuaire d'applications auto-hébergées avec des vrais filtres, du tri, et surtout des indicateurs d'activité. Le mec est aussi derrière la newsletter Self-Host Weekly. L'interface de selfh.st/apps, avec fiches, filtres et indicateurs d'activité Comme ça, au lieu de vous taper une liste brute, vous avez des fiches pour chaque app avec le nombre d'étoiles GitHub, la licence, le langage, les tags, et surtout un code couleur sur la date de dernière activité. Vert si le projet a reçu un commit dans les 6 derniers mois, jaune entre 6 et 12 mois, rouge au-delà d'un an. Pratique pour éviter d'installer un truc que plus personne ne maintient, genre un serveur Plex alternatif mort depuis 2022 ! Et le tri par défaut, c'est pas juste les étoiles GitHub sinon les gros projets à 50 000 étoiles écraseraient tout. L'algo prend en compte l'âge du repo, la date du dernier commit, et même l'intérêt Google Trends pour les projets non-GitHub. Du coup un outil avec 200 stars mais hyper actif peut remonter devant un dinosaure à 30k stars qui dort depuis 18 mois. J'ai trouvé ça pas bête comme filtrage. D'ailleurs, chaque projet a son propre flux RSS filtré qui ne remonte que les releases stables. Pas de bêtas, pas de RC... juste les versions prêtes pour la prod. Comme ça, vous branchez ça dans votre FreshRSS ou Miniflux et vous êtes au courant des mises à jour sans checker chaque repo GitHub à la main ! Par contre, si vous aimez vivre dangereusement sur les nightly, là faudra passer par les flux officiels GitHub. Le site va également plus loin que la simple liste d'apps puisqu'il propose aussi une section "companions", contenant des apps compagnons qui étendent d'autres logiciels auto-hébérgés (genre les extensions navigateur pour Linkedin ou les clients tiers pour Immich...etc). La collection d'icônes pour personnaliser votre Homarr ou Dashy Et surtout, y'a selfh.st/icons avec des milliers d'icônes de dashboard en SVG, PNG et WebP, toutes en 512x512 ratio 1:1, indispensable pour personnaliser votre page d'accueil sur Homarr ou Dashy ! Le catalogue d'apps est sous licence CC0-1.0 (domaine public) et mis à jour tous les matins à 5h du mat' heure de New York (les icônes, elles, sont en CC-BY-4.0, donc pensez à créditer si vous les réutilisez). En 2 minutes de fouille j'y ai trouvé trois projets que je connaissais pas. Et si vous voulez ajouter le vôtre, le repo est ouvert sur https://github.com/selfhst . Et si vous connaissez un outil pour mon projet de QR Code d'upload de photo de mariage, n'hésitez pas à me contacter. Voilà, pour ceux qui font de l'auto-hébergement au quotidien, c'est clairement un bookmark à garder sous le coude. Que vous cherchiez une alternative à Notion, un dashboard pour votre homelab, ou juste un truc pour remplacer un service cloud qui vous gonfle, y'a de quoi fouiller ! Et si vous cherchez des pistes pour commencer, OpenCloud ou Pocket ID sont de bons points de départ. Bref, une mine d'or pour les homelabbers. Merci à Maxime pour le lien ! Afficher l’article complet

-

IT-Connect Publié le 16 mars 2026 Par Florian BURNEL it-connect.fr Environ 8 minutes de lecture Proxmox VE Helper-Scripts : derrière ce nom se cache une collection de plus de 500 scripts Bash prêts à l'emploi. Ils sont conçus pour faciliter l'administration de Proxmox VE et le déploiement d'applications par l'intermédiaire de conteneurs LXC ou de machines virtuelles. L'utilisation de ces scripts facilite l'automatisation des tâches, en particulier pour le déploiement rapide d'applications. C'est particulièrement pratique pour déployer un environnement de développement rapidement : une seule commande suffit à déployer une application. En effet, chaque service dispose de son propre script Bash conçu pour Proxmox et qui permet de déployer une instance avec un service opérationnel. Si vous désirez en savoir plus, regardez la vidéo ci-dessous ou poursuivez la lecture de cet article. A lire également : Proxmox VE : bien débuter avec les conteneurs LXC Proxmox VE : exécuter des images OCI (Docker) nativement dans LXC Proxmox VE : comment créer des conteneurs Docker ? Que sont les Proxmox VE Helper-Scripts ? Les Proxmox VE Helper-Scripts constituent une collection de scripts shell (développés en Bash) conçus pour interagir directement avec l'interface en ligne de commande de Proxmox. Ces scripts ont pour vocation principale d'automatiser le cycle de vie des conteneurs LXC (Linux Containers) et des machines virtuelles (VM). Au lieu de télécharger manuellement un template de distribution Linux, de créer le conteneur, de configurer les interfaces réseaux, d'allouer l'espace de stockage, puis de mettre à jour le système avant d'installer un applicatif, le script se charge de l'ensemble de ces opérations. Le concept plaît : plus de 500 scripts sont disponibles et ils ont été utilisés plus de 2 millions de fois. Ces scripts, référencés sur le site community-scripts.org et référencés sur GitHub, sont organisés par catégories : Docker, réseau, authentification, sécurité, sauvegarde, et j'en passe. Ce sont les sources officielles liées à ce projet : attention à ne pas tomber sur une autre page lors de vos recherches. En parcourant ces catégories, vous pourrez visualiser des scripts pour : Configurer Proxmox VE et en assurer la maintenance, Déployer une application dans un conteneur LXC, Déployer un système d'exploitation (OPNsense, par exemple) ou une application dans une machine virtuelle. Utilisation d'un Helper-Script Quand vous cliquez sur une application ou un service, vous aurez accès à la description, à la ligne de commande permettant de lancer l'installation ou la tâche, et à des informations supplémentaires pour en savoir plus. À chaque fois, je vous encourage à lire la section "NOTES", elle donne des précisions sur le Helper-Script associé et les éventuelles subtilités. De plus, la section de droite nommée "DETAILS" est précieuse puisqu'elle indique : La version déployée du service, Un lien vers le site web de la solution et vers sa documentation, Le fichier de configuration et le numéro de port (utile pour l'accès à l'interface web), Le code source du script d'installation (avec aussi un lien vers la page sur GitHub), Ce dernier point est important : avant d'exécuter un script provenant d'Internet sur votre serveur Proxmox VE, prenez le temps de le consulter ! Même si c'est une source de confiance, soyez vigilant : c'est une règle d'or. Pour lancer l'opération, c'est simple : vous copiez-collez la ligne de code et vous l'exécutez sur votre serveur Proxmox, depuis le Terminal (local ou SSH). Néanmoins, en basculant sur le mode "Advanced", vous pouvez ajuster la configuration du conteneur qui sera créé : CPU, RAM et disque. Par défaut, chaque service a une configuration prédéfinie, mais vous gardez la main. Dans ce cas, des variables avec les nouvelles valeurs seront ajoutées de façon dynamique à la ligne de commande que vous devez exécuter. Par exemple : var_ram="8192" var_disk="32" bash -c "$(curl -fsSL https://raw.githubusercontent.com/community-scripts/ProxmoxVE/main/ct/immich.sh)" Les scripts s'exécutent via une commande de type bash -c associée à l'utilitaire curl chargé de récupérer le script Bash depuis GitHub (ou Gitea). Ainsi, cette commande récupère le code source brut et l'exécute. Un menu interactif s'affiche alors directement dans le terminal afin de vous guider pendant l'installation (sauf si vous passez par le "Generator") L'assistant propose plusieurs modes d'installation : Default Install : ce mode applique des paramètres prédéfinis. Il alloue la RAM, le nombre de cœurs CPU et l'espace disque jugés adéquats par le développeur du script. L'adresse IP sera obtenue via DHCP. Ce mode convient pour des tests rapides. Advanced Install : il est recommandé de choisir ce mode pour personnaliser le déploiement. En effet, il permet de définir manuellement l'ensemble de la configuration : L'ID du conteneur (CT ID). Le type de conteneur (Privilégié ou Non-privilégié). Le mot de passe root de l'instance. Les ressources matérielles allouées (Cœurs CPU, RAM, Swap). Le volume de stockage à utiliser. L'adresse IP statique, le masque de sous-réseau et la passerelle par défaut. Le VLAN tag, utile si votre réseau est segmenté. Etc... User Defaults : il permet d'utiliser les valeurs par défaut définies par vous, l'utilisateur. Quand vous installez une application une première fois, vos choix sont stockés dans un fichier et ce dernier peut être réutilisé par la suite (vous conservez ainsi vos préférences). Une fois les paramètres validés, le script télécharge l'image du système d'exploitation, configure l'instance, la démarre, puis exécute un script de post-installation à l'intérieur du conteneur pour installer l'application (ici, Docker). L'installation s'effectue en totale autonomie et le retour console permet de suivre la progression des opérations. A la fin, quand une application est installée, vous aurez toujours l'URL d'accès, comme ici : http://192.168.110.13:2283. Il suffit d'accéder à cette URL pour accéder à l'application ! Voyez par vous-même. Le générateur de scripts personnalisés Depuis le site officiel de ce projet, vous pouvez accéder à un générateur de scripts pour automatiser l'installation selon une approche sans surveillance. Il vous suffit de cliquer sur "Generator" dans le menu. Vous choisissez le script à personnaliser, à savoir celui de l'application à déployer. Vous définissez ensuite les ressources à attribuer à ce conteneur LXC ou à cette VM. Puis, vous pouvez personnaliser tout le reste : ID de conteneur, nom d'hôte, mot de passe, pont réseau sur lequel se connecter, ID de VLAN ou encore les options comme le SSH, le GPU Passthrough et le Nesting. Une fois la configuration effectuée via cette interface en ligne, vous obtenez une commande prête à l'emploi. Cette commande contient des variables préconfigurées qui sont le reflet des choix effectués via le formulaire du générateur. Voici un exemple : mode=generated var_ctid="500" var_hostname="immich-itconnect" var_vlan="10" var_tags="media" var_gpu="yes" bash -c "$(curl -fsSL https://raw.githubusercontent.com/community-scripts/ProxmoxVE/main/ct/immich.sh)" Si vous lancez la commande obtenue, l'installation sera lancée et vous n'aurez rien à faire ! Tout est automatique (vous noterez la présence de mode=generated). Gérer la maintenance et les opérations d'administration Les Helper-Scripts ne se limitent pas à la création d'instances. De nombreux scripts participent à la maintenance de l'hyperviseur et des conteneurs. Script pour la post-installation de Proxmox VE Il existe également des scripts destinés à configurer l'hôte Proxmox lui-même, en particulier après une nouvelle installation. Ces outils appelés "Post-Install Scripts" automatisent des tâches d'administration courantes et s'adressent à Proxmox VE, mais aussi Proxmox Mail Gateway et Proxmox Backup Server (PBS). Dans le cas de Proxmox VE, le script nommé PVE Post Install effectue un ensemble d'actions : La désactivation du message d'avertissement lié à l'absence de souscription commerciale (Enterprise Repository). L'ajout des dépôts communautaires (No-Subscription Repository) pour permettre les mises à jour du système via apt. La mise à jour du nœud Proxmox VE (paquets) La désactivation des services inutiles si vous n'envisagez pas d'être en mode cluster (réversible) Etc... À chaque fois, vous avez le choix : vous gardez le contrôle. Le script n'impose rien. Script de mise à jour des conteneurs LXC Certains applicatifs hébergés en LXC ne disposent pas de mécanisme de mise à jour interne simple. Des scripts spécifiques permettent d'automatiser ce processus. En exécutant un script de mise à jour (souvent nommé update script), le système se connecte au conteneur, arrête les services concernés, télécharge la dernière version de l'application depuis son dépôt officiel, l'installe et redémarre le service, le tout en préservant les données de configuration de l'utilisateur. Il y a en réalité deux catégories de scripts de mises à jour : Les scripts pour mettre à jour l'OS dans les conteneurs LXC (ils ne touchent pas à l'application). Les scripts pour mettre à jour l'application en elle-même. Par exemple, le script PVE LXC Updater sert justement à mettre à jour le système d'exploitation. De son côté, le script PVE LXC Apps Updater met à jour les applications. Pour cela, il surveille les tags sur les conteneurs LXC afin de cibler les conteneurs avec le tag community-script ou proxmox-helper-scripts (par défaut, car c'est personnalisable). Script de sauvegarde Proxmox VE Un dernier cas d'usage et script que l'on peut citer : PVE Host Backup. Ce script permet aux utilisateurs de sauvegarder des données, tout en offrant la possibilité de sélectionner les fichiers et répertoires spécifiques à sauvegarder. Cette flexibilité lui permet une compatibilité large, qui va au-delà de Proxmox (merci Bash). Dans le contexte de Proxmox VE, ce script facilite la sauvegarde des fichiers systèmes. Conclusion L'utilisation des Proxmox VE Helper-Scripts représente une méthode efficace pour rationaliser les déploiements de services en limitant les opérations manuelles et répétitives. Si vous aimez tester différentes applications, cela représentera un gain de temps ! Vous pouvez aussi vous inspirer de ces scripts pour coder vos propres scripts d'installation. Veillez toujours à privilégier l'utilisation de conteneurs non privilégiés et à réviser le code source du script avant l'exécution. Ceci est particulièrement vrai pour les applications où il y a peu d'installations, bien que les Helper-Scripts soient largement utilisés et révisés par la communauté. Ingénieur système et réseau, cofondateur d'IT-Connect et Microsoft MVP "Cloud and Datacenter Management". Je souhaite partager mon expérience et mes découvertes au travers de mes articles. Généraliste avec une attirance particulière pour les solutions Microsoft et le scripting. Bonne lecture. Afficher l’article complet

-

Proxmox Bloquer les publicités sur un réseau avec AdGuard Home - IT-Connect

Ldfa a posté un sujet dans Mon Wallabag

IT-Connect Publié le 6 avril 2026 Par Florian BURNEL it-connect.fr Environ 24 minutes de lecture Ce guide technique explique comment installer et configurer la solution open source AdGuard Home pour bloquer les publicités et les sites malveillants à l'échelle d'un réseau. La question suivante sera aussi abordée : comment bénéficier du blocage des publicités depuis n'importe où ? Grâce à la mise en place de la solution AdGuard Home, vous reprenez le contrôle sur votre navigation. Je dirais même que, d'une façon générale, vous allez avoir plus de contrôle sur les connexions effectuées par les appareils connectés à votre réseau. En effet, au-delà de bloquer les publicités, une solution comme celle-ci peut aussi bloquer les solutions de tracking et de suivi, ainsi que des sites indésirables ou malveillants. AdGuard Home est capable de nettoyer les flux réseau sur l'ensemble des appareils : de votre ordinateur à votre smartphone, en passant par votre TV connectée à Internet. Se pose alors une première question : comment fonctionne ce mécanisme de blocage ? Avant de parler de la solution AdGuard Home et du choix de cette solution, prenons un instant pour évoquer le mécanisme de blocage. Tout va jouer au niveau du DNS. Pour rappel, le système de noms de domaine (DNS) agit comme l'annuaire d'Internet. Lorsque vous tapez l'adresse d'un site web dans votre navigateur, votre ordinateur interroge un serveur DNS pour traduire ce nom de domaine en une adresse IP compréhensible par les machines. Sans cela, on serait obligé de connaître les adresses IP des sites par cœur : c'est tout simplement impossible. Ainsi, quand vous accédez à un site web comme www.domaine.fr, votre machine interroge le serveur DNS configuré dans les paramètres réseau de votre ordinateur pour obtenir l'adresse IP correspondante. Le blocage au niveau DNS, souvent appelé "DNS sinkholing" (que l'on appelle aussi trou noir DNS, ou DNS menteur), intervient exactement à cette étape. Lorsqu'une page web tente de charger une publicité ou un script de suivi, elle effectue une requête vers un domaine spécifique (par exemple, ads.serveur-publicite.com). Si vous utilisez AdGuard Home comme serveur DNS, celui-ci compare chaque requête à une liste de filtres (blocklists). Si le domaine demandé figure dans ces listes, AdGuard Home refuse de résoudre l'adresse IP réelle et renvoie une réponse invalide (comme 0.0.0.0). Le résultat est direct : l'appareil ne peut pas contacter le serveur publicitaire, et la publicité ne s'affiche pas. Cette méthode est légère, rapide et s'applique à tous les appareils utilisant ce serveur DNS. Le site web visité, quant à lui, continuera de fonctionner correctement. En effet, si vous accédez à IT-Connect via www.it-connect.fr et que vous bloquez les publicités chargées depuis www.domaine-pub.fr, il n'y a que les contenus relatifs à la publicité qui sont bloqués. Pour certains sites mondiaux, c'est parfois difficile, car les publicités et le site web sont chargés depuis le même domaine : dans ce cas, le blocage des publicités par DNS ne peut pas fonctionner. Les fonctionnalités principales d'AdGuard Home AdGuard Home est une solution open source, gratuite et éprouvée. Elle est développée et maintenue depuis plusieurs années. Sa principale alternative est elle aussi open source et s'appelle Pi-Hole. Il en existe d'autres, comme Blocky. AdGuard Home se distingue par une interface moderne et des fonctionnalités complètes, on peut citer : Filtrage des requêtes DNS : blocage des publicités, des traqueurs et des domaines malveillants en s'appuyant sur des listes maintenues par la communauté. Sur le papier, vous pouvez bloquer n'importe quel site web grâce aux règles personnalisées. Contrôle parental : possibilité d'activer la recherche sécurisée (Safe Search) sur les principaux moteurs de recherche (Google, Bing, DuckDuckGo) pour filtrer les contenus inappropriés. Blocage de services : une section dédiée permet de bloquer rapidement des applications ou des services populaires (comme TikTok, YouTube, WhatsApp, etc.) sans avoir à chercher manuellement les domaines associés. Du blocage en 1-clic. Gestion par client (appareil) : vous pouvez appliquer des règles de filtrage spécifiques en fonction de l'adresse IP, de l'adresse MAC ou du nom de l'appareil. Cette gestion par appareil offre beaucoup de souplesse. Chiffrement DNS : par défaut, les flux du DNS ne sont pas protégés (pas de chiffrement). AdGuard Home offre l'avantage de supporter nativement des protocoles sécurisés comme DNS-over-HTTPS (DoH) et DNS-over-TLS (DoT). Cela est vrai pour échanger avec les clients et les serveurs DNS upstreams (résolveurs). Où peut-on installer AdGuard Home ? AdGuard Home est conçu pour être léger et peu gourmand en ressources, ce qui permet de le déployer sur une grande variété d'équipements. Il existe des images Docker et des programmes d'installation pour différents OS. On peut donc imaginer les scénarios d'installation suivants : Sur un NAS : Docker est pris en charge par toutes les marques (Synology, QNAP, ASUSTOR, UGREEN, etc.). Sur un nano-ordinateur : un Raspberry Pi est parfaitement adapté (via cette commande : curl -s -S -L https://raw.githubusercontent.com/AdguardTeam/AdGuardHome/master/scripts/install.sh | sh -s -- -v) Sur un serveur Linux ou un VPS : que ce soit sous Debian, Ubuntu ou Alpine Linux (via cette commande : curl -s -S -L https://raw.githubusercontent.com/AdguardTeam/AdGuardHome/master/scripts/install.sh | sh -s -- -v) Directement sur Windows ou macOS : bien que ce soit moins courant pour un usage en réseau, des exécutables sont disponibles. Ce qui est important, c'est que l'appareil soit disponible 24/7 sur votre réseau, car AdGuard Home va devenir indispensable pour assurer le bon fonctionnement de votre connexion Internet. Un NAS ou un Raspberry Pi, c'est l'idéal. Dans le cadre de ce tutoriel, nous nous concentrerons sur une installation conteneurisée via Docker. L'avantage étant de pouvoir reproduire cette configuration sur différents types d'équipements à partir du moment où Docker est présent. Tutoriel - Installer AdGuard Home sur un NAS Synology AdGuard Home : ce qu'il peut bloquer & ce qu'il ne peut pas bloquer Entre les services en ligne et les bloqueurs de publicités, c'est un peu le jeu du chat et de la souris. Chacun essaie de prendre le dessus sur l'autre. Résultat, AdGuard Home ne peut pas bloquer toutes les publicités. Ce n'est pas qu'il est mauvais, c'est qu'il est limité par son mode de fonctionnement basé sur le DNS et aussi parce qu'en face, il y a beaucoup de services qui utilisent des techniques difficiles à contourner. Voici un état des lieux : Type de contenu AdGuard Home Explication technique Bannières classiques et pop-ups ✅ Bloqué La publicité provient d'un serveur tiers. AdGuard Home bloque la résolution DNS du domaine externe. Selon la façon dont est implémentée la publicité, cela peut laisser un espace blanc sur le site web. Télémétrie et traqueurs ✅ Bloqué Excellente efficacité contre les outils d'analyse (Google Analytics), le pistage Windows, IoT ou Smart TV qui communiquent avec des serveurs dédiés. Pubs "In-App" (smartphones/jeux) ✅ Bloqué Les applications mobiles gratuites font généralement appel à des régies publicitaires externes (domaines tiers) facilement identifiables et neutralisables. Publicités vidéo (YouTube, Twitch) ❌ Non bloqué La publicité et la vidéo légitime sont diffusées par le même domaine de streaming. Bloquer la pub revient à bloquer le site, ce qui empêche son fonctionnement. Posts sponsorisés sur les réseaux sociaux ❌ Non bloqué Sur Facebook, Instagram ou X (Twitter), les annonces sponsorisées sont injectées directement dans le flux d'actualité depuis les serveurs de la plateforme. AdGuard Home ne peut rien y faire. Installation d'AdGuard Home avec Docker Pour ce déploiement, je vous propose d'utiliser un mode réseau bien spécifique au niveau de Docker : le macvlan. Ce mode permet d'attribuer une adresse IP distincte de celle du serveur Docker directement au conteneur AdGuard Home. Ainsi, il aura sa propre adresse IP pour communiquer avec les appareils du réseau. Vous pourriez tout à fait utiliser le mode habituel (bridge) pour ce conteneur, mais AdGuard Home partagerait l'adresse IP du serveur Docker. Dans ce cas, et à cause du mécanisme de NAT interne à Docker, vous ne pourriez pas voir l'adresse IP source des clients. Donc, au niveau d'AdGuard Home, toutes les requêtes seront associées à un seul client, ce qui veut dire que vous n'aurez pas de statistiques par client (ni la possibilité de faire des règles par client) dans AdGuard Home. Si ce n'est pas important pour vous, alors l'utilisation d'un réseau macvlan est facultative. Personnellement, je trouve cela contraignant. Avant de commencer, je vous rappelle que le conteneur AdGuard Home doit être joignable sur le port 53 (standard pour le DNS). D'autres ports seront utilisés en fonction des services activés (serveur DHCP géré par AdGuard Home, par exemple). Création du réseau MacVlan en ligne de commande Il est préférable de créer le réseau MacVlan manuellement en amont. La raison est simple : vous ne pouvez avoir qu'un seul réseau MacVlan rattaché à une interface physique. Peut-être même que vous en avez déjà un, selon les services déjà déployés sur votre serveur Docker. Si ce n'est pas le cas, l'idée c'est de le créer puis d'y connecter ensuite le conteneur AdGuard Home. Par la suite, vous pourriez tout à fait connecter d'autres conteneurs à ce réseau. Pour cela, ouvrez un Terminal sur votre serveur ou lancez une connexion SSH. ssh <nom utilisateur>@<IP du serveur Docker> Une fois connecté en SSH, exécutez la commande docker network indiquée ci-dessous. Attention : veillez à adapter l'interface parent (eth0), le sous-réseau (subnet), la passerelle de votre routeur (gateway) et la plage d'IP souhaitée (ip-range) à votre propre réseau local. Si vous avez connecté l'interface 1 de votre serveur Docker au réseau, cela devrait être eth0. Vous pouvez le vérifier en saisissant la commande ip a et en regardant quel est le nom de l'interface où est configurée l'adresse IP de votre serveur. Voici la commande à exécuter pour créer le réseau MacVlan : docker network create -d macvlan \ -o parent=eth0 \ --subnet=192.168.10.0/24 \ --gateway=192.168.10.254 \ --ip-range=192.168.10.144/28 \ macvlan_net Dans l'exemple ci-dessous, un masque /28 est utilisé. Ainsi, avec la plage 192.168.10.144/28, cela mettra à disposition de Docker les adresses allant de 192.168.10.144 à 192.168.10.159. De quoi vous permettre de connecter jusqu'à 14 conteneurs via ce réseau MacVlan. Ensuite, vous pouvez vérifier l'existence de ce réseau et afficher sa configuration via ces deux commandes : docker network ls docker network inspect macvlan_net Note : l'idéal, c'est que cette plage d'adresses IP (de .144 à .159) soit exclue de la plage de distribution de votre serveur DHCP (votre box Internet ou votre routeur). Cela assure qu'il n'y aura pas de conflits. Déploiement AdGuard Home avec Docker Compose Maintenant que le réseau macvlan_net existe, nous pouvons créer notre fichier docker-compose.yml. Mais avant cela, créons l'arborescence de dossiers pour la persistance des données d'AdGuard Home. sudo mkdir -p /opt/docker-compose/adguard-home/{workdir,confdir} Note : le dossier confdir contiendra le fichier de configuration AdGuardHome.yaml. Ce fichier contient l'ensemble de la configuration d'AdGuard Home. Créez un fichier docker-compose.yml : sudo touch /opt/docker-compose/adguard-home/docker-compose.yml Insérez la configuration suivante dans ce fichier : services: adguardhome: image: adguard/adguardhome:latest container_name: adguard restart: unless-stopped volumes: - ./workdir:/opt/adguardhome/work - ./confdir:/opt/adguardhome/conf networks: macvlan_net: ipv4_address: 192.168.10.151 # L'IP accessible par tous les appareils du réseau local adguard_bridge: ipv4_address: 10.10.10.2 # L'IP interne accessible par le NAS/serveur hôte networks: macvlan_net: external: true adguard_bridge: driver: bridge ipam: config: - subnet: 10.10.10.0/24 gateway: 10.10.10.1 Lancez ensuite la création du conteneur en vous plaçant dans le dossier contenant le fichier, puis exécutez : docker compose up -d L'application va s'initialiser et si vous consultez les journaux (docker compose logs), vous devriez voir ceci : adguard | [info] webapi: AdGuard Home is available at the following addresses: adguard | [info] go to http://127.0.0.1:3000 adguard | [info] go to http://[::1]:3000 adguard | [info] go to http://10.10.10.2:3000 adguard | [info] go to http://192.168.10.151:3000 adguard | [info] starting plain server server=plain addr=0.0.0.0:3000 Premiers pas avec AdGuard Home Une fois le conteneur démarré, ouvrez votre navigateur web et rendez-vous sur l'adresse IP que nous avons définie, suivie du port d'installation par défaut : http://192.168.10.151:3000. Si cela ne fonctionne pas, et que votre machine Docker est une machine virtuelle, le commutateur virtuel (vSwitch) de votre hyperviseur bloque très probablement la connexion. Pourquoi ? En réalité, le réseau Macvlan génère une nouvelle adresse MAC virtuelle pour le conteneur. Par sécurité, les hyperviseurs bloquent le trafic destiné à une adresse MAC qu'ils n'ont pas explicitement attribuée à la VM. La solution consiste à modifier les paramètres de la machine virtuelle pour autoriser ce phénomène. Ce sera une configuration à effectuer sur plusieurs plateformes (Hyper-V, VMware, Proxmox...). Dans le cas d'Hyper-V, utilisé pour cet exemple, voici l'option à activer. Configuration initiale Un assistant de configuration va vous accueillir. Cinq étapes rapides à compléter nous attendent. Cliquez sur le bouton pour commencer. Vous devez indiquer sur quelle interface réseau (et quel port) sera joignable l'interface d'administration. La même chose est demandée pour le serveur DNS (port 53). Laissez par défaut (important pour le DNS si le serveur Docker doit aussi utiliser AdGuard Home comme DNS) ou sélectionnez l'interface correspondant à votre IP 192.168.10.151. Créer un compte administrateur : choisissez un nom d'utilisateur et un mot de passe robuste. AdGuard Home vous explique rapidement comment configurer vos appareils. En effet, la mise en œuvre d'une telle solution implique une modification de la configuration des appareils de votre réseau. Il ne sera pas nécessaire de configurer manuellement chaque appareil, comme nous le verrons ensuite. Une fois ces étapes validées, le tableau de bord principal sera accessible sur http://192.168.10.151 (sans le port 3000). Voilà, la configuration initiale est terminée ! Le tableau de bord affiche des statistiques d'utilisation (requêtes DNS totales, requêtes bloquées, etc.). Le menu présent en haut permet d'accéder aux différentes sections de la configuration. Actuellement, AdGuard Home est opérationnel. Sa configuration en sortie de boîte permet de filtrer les publicités. Néanmoins, il est préférable d'ajuster sa configuration pour en profiter pleinement, c'est ce que nous allons voir. Configuration des DNS upstreams (serveurs en amont) AdGuard Home ne connaît pas toutes les adresses IP des sites web. Lorsqu'il reçoit une requête DNS légitime, il doit la transmettre à un serveur DNS externe capable de la résoudre. C'est un tiers de confiance et vous avez le choix du serveur, ou je dirais même, des serveurs, que vous souhaitez solliciter. Allez dans Paramètres > Paramètres DNS. Dans la section "Serveurs DNS en amont", vous pouvez renseigner les serveurs DNS de votre choix. Certains sont réputés pour être plus respectueux de la vie privée que d'autres, certains feront eux aussi du filtrage, etc... Il y a le choix. Surtout, AdGuard Home peut interroger ces serveurs DNS via le protocole DNS traditionnel (flux en clair) ou via DoH ou DoT, ce qui permet de chiffrer les flux. Il est donc préférable d'utiliser des serveurs DNS upstreams compatibles DoH ou DoT. Par exemple les serveurs de Quad9 et Cloudflare via DNS-over-HTTPS : https://dns10.quad9.net/dns-query https://dns.cloudflare.com/dns-query Vous pouvez visiter cette page pour avoir une liste complète de serveurs que vous pouvez solliciter en tant que résolveur DNS. Par défaut, le mode "Équilibrage de charge" est sélectionné, ce qui signifie que tous les serveurs présents dans votre liste de serveurs upstreams seront sollicités. Par exemple, AdGuard pourra solliciter un serveur DNS pour répondre à un client, et à la prochaine sollicitation, il contactera l'autre serveur DNS. Même si en réalité, AdGuard priorisera celui qui offre les meilleures performances (vous le verrez dans les statistiques). Vous pouvez aussi choisir le mode "Requêtes en parallèle" pour qu'AdGuard sollicite plusieurs serveurs en même temps. Un peu plus bas dans la page, vous allez tomber sur une section nommée "Serveurs DNS d'amorçage". Il s'agit de serveurs DNS qu'AdGuard sollicitera pour résoudre les adresses des serveurs DoH. En effet, quand on indique à AdGuard d'utiliser https://dns10.quad9.net/dns-query comme serveur upstream, il doit forcément résoudre ce nom au moins une fois (dns10.quad9.net). D'autres paramètres sont disponibles pour vous permettre de gérer le comportement du cache, de définir des résolveurs privés (notamment pour les zones de recherche inversées) et le type de blocage. Ce dernier point fait écho à mes propos précédents. En effet, vous indiquez à AdGuard Home comment il doit bloquer les sites correspondant à de la publicité ou autre... Le mode par défaut indique bien "Répondre avec adresse IP zéro", ce qui veut bien dire qu'AdGuard Home va mentir au client DNS en lui indiquant que l'IP de la ressource est 0.0.0.0. Pensez à enregistrer les paramètres modifiés au niveau de chaque section de cette même page. Gestion des listes de filtrage Par défaut, AdGuard Home utilise sa propre liste de blocage. Pour aller plus loin et améliorer la sécurité de votre réseau, je vous recommande d'ajouter des listes supplémentaires. La gestion de ces listes s'effectue ici : Filtres > Listes de blocage DNS. Cliquez sur le bouton "Ajouter liste de blocage". Vous pouvez sélectionner des listes communautaires depuis une liste préconfigurée dans AdGuard Home ou ajouter vos propres listes. L'objectif étant d'utiliser des listes qui offrent un bon ratio de blocage avec très peu de faux positifs (sites légitimes bloqués par erreur). Sinon, cela va devenir un enfer à gérer. Je vous recommande ces listes : Steven Black (reconnue mondialement) : https://adguardteam.github.io/HostlistsRegistry/assets/filter_33.txt Phishing URL Blocklist (PhishTank and OpenPhish) : https://adguardteam.github.io/HostlistsRegistry/assets/filter_30.txt Nicolas Pawlak (Red Flag Domains) pour bloquer les domaines malveillants (tentative d'usurpation de marques) : https://dl.red.flag.domains/adguard/red.flag.domains.txt Ajoutez ces listes une par une. Comme le montre l'image ci-dessous, ces listes contiennent plusieurs dizaines de milliers de règles. Si vous piochez directement dans la liste des listes proposées par AdGuard Home, vous verrez qu'elles sont organisées par catégorie. Je vous invite à cliquer sur le bouton en forme de maison pour accéder au site de la liste afin d'en savoir plus avant de l'activer. Par ailleurs, dans le menu "Filtres", il y a une entrée nommée "Règles de filtrage personnalisées". Cela vous permet de déterminer des règles de blocage ou d'autorisation personnalisées. Quand vous allez créer des exclusions via le "Journal des requêtes", cela viendra alimenter cette section. AdGuard Home intègre son propre moteur de gestion de règles, ce qui vous permet de créer du sur-mesure. Une règle || sert à bloquer, tandis qu'une règle @@|| sert à autoriser (débloquer). L'exemple ci-dessous permet de débloquer la plateforme d'affiliation awin.com, que j'utilise pour IT-Connect. C'est un système très flexible. En effet, vous pouvez gérer des clients dans AdGuard Home (c'est-à-dire vos appareils) et chaque appareil peut avoir un type (PC, NAS, mobile, etc...). Ainsi, vous avez la possibilité de créer des règles qui s'appliqueront uniquement à certains clients nommés ou certains types de clients. L'exemple ci-dessous sert à bloquer le domaine exemple.fr pour tous les clients, sauf ceux qui ont le tag device_phone. ||exemple.fr^$ctag=~device_phone La syntaxe des règles de blocage est expliquée sur cette page. Blocage des services L'une des forces de l'outil AdGuard Home, c'est sa capacité à bloquer des services populaires : ChatGPT, Tinder, Xbox Live, Dropbox, Microsoft Teams, Proton, Amazon, eBay, etc.... Une liste prédéfinie est disponible ici : Filtres > Services bloqués. Si vous souhaitez empêcher l'accès aux réseaux sociaux (ou à un autre service) sur une plage horaire ou de manière permanente, il suffit de cocher le nom du service et de sauvegarder. AdGuard Home s'occupe alors de bloquer tous les domaines liés à ce service ! En bas de page, vous pouvez aussi créer des règles selon une plage horaire. Gestion des clients Pour appliquer des règles de filtrage ou d'exclusion spécifiques, AdGuard Home doit pouvoir identifier l'origine des requêtes DNS. La solution propose quatre méthodes pour effectuer une identification des clients : Adresse IP (192.168.1.98) : la méthode la plus directe est d'identifier le client à partir de son adresse IP. Mais, attention, l'équipement doit disposer d'une IP fixe (ou d'une réservation DHCP) pour garantir que l'identification reste fiable dans le temps. S'il change d'adresse IP, cela va perturber forcément le bon fonctionnement. Plage CIDR (192.168.1.0/24) : permet d'appliquer une stratégie à un sous-réseau entier. Idéal pour traiter par lots un réseau invité ou un VLAN dédié aux objets connectés (IoT). Vous fonctionnez par sous-réseau plutôt que par client. Adresse MAC (AA:BB:CC:DD:EE:FF) : fiable car cette méthode est liée à l'interface matérielle de l'appareil. Néanmoins, cette fonctionnalité requiert que le service DHCP soit géré par AdGuard Home lui-même, et non par votre box ou routeur. ClientID (DNS chiffré) : une approche avancée réservée lors de l'utilisation des protocoles sécurisés (DoH, DoT ou DoQ). Le client s'identifie au travers d'une URL personnalisée (par exemple : https://dns.domaine.fr/dns-query/mon-client). La gestion des clients permet d'avoir une idée précise de "qui a accédé à quoi" au niveau du réseau, bien que ce soit tout de même restreint à tout accès qui implique une requête DNS en amont. Mais, c'est aussi une façon de ne pas appliquer les mêmes règles à tous les appareils. Pour gérer les clients, accédez à : Paramètres > Paramètres du client. Vous pouvez identifier une machine par son adresse IP ou son adresse MAC et lui attribuer une politique spécifique : par exemple, désactiver le blocage de certains services pour votre ordinateur de travail, mais l'activer pour les tablettes des enfants. Vous pouvez visualiser vos clients existants et en ajouter des nouveaux. Quand vous ajoutez un client, vous devez le nommer, lui associer des mots-clés (c'est-à-dire un ou plusieurs tags), et surtout un identifiant (selon l'une des méthodes évoquées ci-dessus). Vous avez la possibilité de lui associer des règles spécifiques, comme l'activation du contrôle parentale, la recherche sécurisée, etc. Les journaux d'accès La section "Journal des requêtes" accessible depuis le menu principal, permet de visualiser, en temps réel, quelles sont les requêtes DNS traitées par AdGuard Home. Vous verrez les requêtes autorisées et celles bloquées. Quand c'est bloqué, vous saurez de quelle liste provient le blocage (AdGuard DNS Filter, sur l'exemple ci-dessous). Pour chaque ligne, vous avez plusieurs informations : la date et l'heure, le nom de domaine cible, l'action, et le client à l'origine de la demande. Sur chaque ligne, vous avez aussi trois points verticaux permettant d'accéder à un menu. Quatre actions sont proposées : Débloquer : pour créer une règle permettant d'autoriser le domaine en question (de quoi gérer les faux positifs), Débloquer uniquement pour ce client : comme l'action précédente, mais en autorisant le flux uniquement pour ce client, Interdire ce client : pour bloquer totalement cet appareil. Ajouter comme client persistant : pour ajouter cet appareil comme nouveau client persistant dans votre base (ce qui va alimenter Paramètres > Paramètres du client). Vous pouvez aussi rechercher un domaine, un client, ou filtrer par type de journaux. Ci-dessous, le filtre est positionné sur "Services bloqués", ce qui permet d'afficher les requêtes pour les services bloqués via la section suivante : Filtres > Services bloqués. AdGuard Home bloque un site, que faire ? N'allez pas croire qu'AdGuard Home est une solution miracle qui ne nécessite pas de maintenance. Au début, vous aurez forcément besoin de faire des ajustements dans la configuration, notamment pour débloquer les faux positifs ou les services que vous utilisez et qui ont été bloqués. Par exemple, si vous utilisez le service de streaming TF1+ pour regarder des programmes en ligne, vous serez confronté à une erreur comme celle-ci : La raison est simple : TF1+ dispose de capacités de détection lui permettant de voir que vous essayez de bloquer les publicités. Par conséquent, il vous empêche de lire la vidéo. Face à cette situation que vous allez très certainement rencontrer, que faire ? Voici trois options pour contourner ce blocage : La liste blanche (ciblée) : ajoutez manuellement les adresses des serveurs publicitaires de TF1 dans vos règles de filtrage personnalisées AdGuard. L'analyse en direct (sur-mesure) : lancez la vidéo, consultez le journal des requêtes d'AdGuard et débloquez à la volée les lignes rouges qui s'affichent au moment du blocage. L'exclusion de l'appareil (déconseillé) : enregistrez l'adresse IP de votre TV ou Box dans les paramètres clients d'AdGuard pour désactiver totalement le filtrage antipub sur cet écran précis. Vous devez donc passer par le "Journal des requêtes" pour identifier les flux bloqués et faire le nécessaire. Pour TF1+, à l'heure actuelle, vous pouvez ajouter ces règles dans le filtrage personnalisé (pour débloquer ces domaines) : @@||pub.tf1.fr^ @@||s.tf1.fr^ @@||adproxy.tf1.fr^ @@||ads.stickyadstv.com^ @@||tf1-fram.adswizz.com^ La configuration des clients pour AdGuard Home Votre serveur AdGuard Home est activé, il est configuré, mais pour autant, il ne bloque pas encore les publicités sur vos appareils. C'est normal. Vous devez l'utiliser en tant que serveur DNS. Sur un réseau domestique, la Box est utilisée par défaut en tant que DNS. Mais, là, vous devez solliciter votre serveur AdGuard Home. Plusieurs options sont possibles pour effectuer la configuration des clients : Modifier la configuration du DHCP sur votre box (ou routeur) pour diffuser l'adresse IP de votre serveur AdGuard Home comme DNS. Au niveau des options, cela dépend si vous utilisez une Box Orange, Free, Bouygues, etc. Utiliser AdGuard Home comme DHCP, et donc diffuser son IP comme serveur DNS. Veillez à désactiver le DHCP de la Box si vous partez sur cette méthode. Éditez manuellement la configuration IP d'un appareil pour spécifier l'adresse IP du serveur AdGuard Home comme serveur DNS. Méthode nécessaire sur les appareils avec une adresse IP fixe, et dans un premier temps pour faire un test de bon fonctionnement. Sur Windows, cela revient à spécifier l'adresse IP du serveur AdGuard Home de cette façon : À partir du moment où la configuration sera effective, vous verrez de premières lignes arriver dans le journal des accès d'AdGuard Home. Bloquer les publicités depuis n'importe où Si vous désirez profiter du blocage des publicités depuis n'importe où, c'est-à-dire y compris lorsque vous n'êtes pas connecté à votre réseau local, sachez que c'est possible. Vous devez utiliser une connexion VPN vers votre réseau local, afin d'appliquer le même principe : utiliser le serveur AdGuard Home comme serveur DNS. Pour mettre en place cette connexion à distance, plusieurs solutions sont envisageables : Utiliser un VPN de type OpenVPN ou WireGuard, ce second étant recommandé pour de meilleures performances, Utiliser une solution comme Tailscale ou Twingate pour mettre en place un réseau maillé sécurisé entre vos appareils (approche ZTNA). Il existe tout de même une autre solution qui n'implique même pas l'utilisation d'un VPN : DNS-over-HTTPS. Vous pouvez exposer votre serveur AdGuard Home sur Internet sous la forme d'un serveur DNS compatible DNS-over-HTTPS (DoH). Ainsi, vous n'exposez pas directement l'interface d'administration de la solution, mais bien le point d'entrée sécurisé en HTTPS. Pour cela, vous devez : Activer l'option "Activer le chiffrement (HTTPS, DNS-over-HTTPS et DNS-over-TLS)" dans les paramètres de chiffrement d'AdGuard Home. Ce qui implique également d'importer un certificat TLS pour chiffrer les connexions. Publier AdGuard Home via un reverse proxy ou Cloudflare, de façon à publier de façon sécurisée votre instance comme vous pourriez le faire avec une autre solution. Note : sans cette configuration, AdGuard Home peut tout de même contacter les résolveurs DNS externes (upstreams) via DoH ou DoT. Conclusion Le déploiement d'AdGuard Home sur un réseau local est une démarche efficace pour assainir sa navigation web. En centralisant le filtrage au niveau du protocole DNS, vous protégez d'un seul coup l'ensemble des équipements de votre réseau, y compris les objets connectés ou les TV connectées sur lesquels l'installation d'un bloqueur de publicités n'est pas toujours possible. Je publierai très prochainement des articles complémentaires pour vous expliquer comment utiliser AdGuard Home en tant que DoH, mais pas seulement. Qu'est-ce qu'AdGuard Home ? C'est un logiciel open source agissant comme un serveur DNS pour filtrer les requêtes réseau, bloquant ainsi les publicités et le suivi à l'échelle de tout un réseau. Quelle est la différence entre AdGuard Home et Pi-hole ? Pi-hole est l'outil historique, très populaire. AdGuard Home, écrit en Go, est plus récent et propose nativement des fonctionnalités comme le chiffrement DNS (DoH/DoT) et le blocage d'applications spécifiques, sans nécessiter de configurations additionnelles. Les deux applications répondent aux mêmes besoins : le blocage des publicités. AdGuard Home bloque-t-il les publicités sur YouTube ? Le blocage des publicités YouTube via DNS est complexe car Google sert ses vidéos et ses publicités depuis les mêmes noms de domaine. AdGuard Home ne peut pas bloquer ces publicités de manière fiable sans risquer de bloquer la vidéo elle-même. Est-ce qu'AdGuard Home ralentit ma connexion Internet ? Non, je dirais même qu'il aura a tendance à l'accélérer ! En bloquant les publicités et les scripts lourds avant même qu'ils ne soient téléchargés, les pages web se chargent plus rapidement et la bande passante est économisée. Puis-je utiliser AdGuard Home en dehors de mon réseau local ? C'est possible si vous le couplez avec un serveur VPN personnel (comme WireGuard ou OpenVPN) ou des solutions de réseau maillé comme Tailscale ou Twingate. Vos appareils mobiles profiteront ainsi du filtrage même en 4G/5G. Qu'est-ce qu'un serveur DNS "upstream" ou en amont ? C'est le serveur DNS public (comme ceux de Cloudflare, Google, ou Quad9) vers lequel AdGuard Home transfère vos requêtes si le domaine demandé n'est pas bloqué par vos listes. C'est ce qui vous permet d'avoir accès à Internet. Ingénieur système et réseau, cofondateur d'IT-Connect et Microsoft MVP "Cloud and Datacenter Management". Je souhaite partager mon expérience et mes découvertes au travers de mes articles. Généraliste avec une attirance particulière pour les solutions Microsoft et le scripting. Bonne lecture. Afficher l’article complet -

Proxmox Proxmox VE : comment créer des conteneurs Docker ? - IT-Connect

Ldfa a posté un sujet dans Mon Wallabag