-

Compteur de contenus

30 023 -

Inscription

-

Dernière visite

-

Jours gagnés

1 156

Type de contenu

Profils

Forums

Calendrier

Tout ce qui a été posté par Ldfa

-

Chat Il n'y a pas que les oiseaux qui se cachent pour mourir

Ldfa a posté un sujet dans La machine à café

Canela, ma compagne féline depuis déjà 10 ans et âgée de 16 ans, a passé toute la journée d'hier à tourner en rond dans la maison, en se cachant sous la cheminée, derrière le canapé ou même derrière une porte. Épuisée, elle avait du mal à marcher en fin de journée, je l'ai allongée sur son coussin et je l'ai caressé longuement afin de la calmer. J'étais en train de regarder la fin du film L'incroyable femme des neiges avec Blanche Gardin, Philippe Katerine, Bastien Bouillon entre autres. À la fin du film, Spoiler on entend des chants Inuit jusque à la fin du générique. Mon chat semblait vraiment apprécier cette ambiance sonore apaisante. Ce matin, je l'ai trouvé dans la même position que je l'avais laissé la veille, elle ne s'est pas réveillée, elle est partie dans son sommeil apaisé. -

Maxthon 7 totalise plus de 10 instances dans le gestionnaire de tâche de Windows

Ldfa a répondu à un(e) sujet de Michel43 dans Questions et astuces sur Mx6 & Mx7

J'ai posé la question au Chat de Mistral pour Chrome, Maxthon utilisant Chromium comme lui et voici sa réponse : C'est donc bien le fonctionnement normal des navigateurs Web, entre autres. -

Ce n'est pas possible pour l'instant à mon avis, le mieux c'est de rester sur la dernière version 7.5.2.5801 qui n'avait pas le nouveau système de téléchargement.

-

-

-

Win Traduction française de Mx7 pour Windows

Ldfa a répondu à un(e) sujet de Ldfa dans Traductions françaises de Maxthon sur Crowdin

Traduction approuvée. fr.ini -

Win Traduction française de Mx7 pour Windows

Ldfa a répondu à un(e) sujet de Ldfa dans Traductions françaises de Maxthon sur Crowdin

There are new strings to translate in the Maxthon pour Windows project. You were a project participant previously so your help will be appreciated a lot. 1 new string for translation (7 words). -

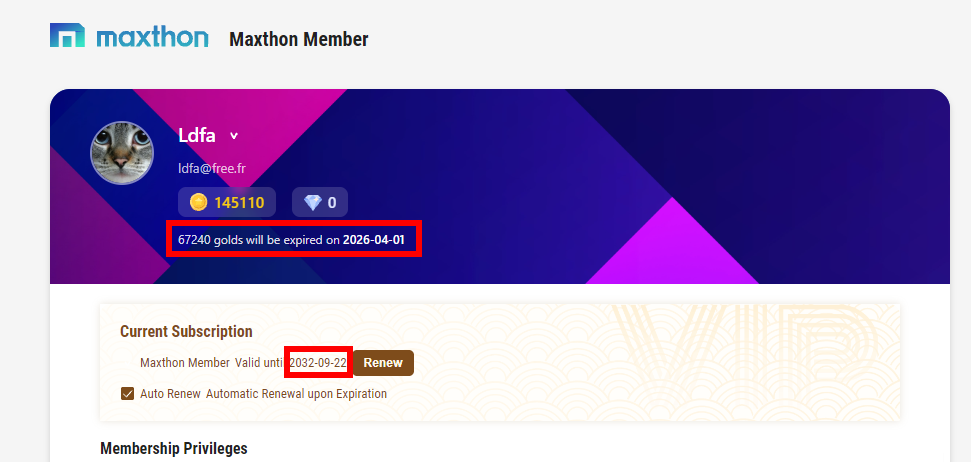

Rappel concernant l'expiration des pièces Important : Certaines pièces d'or obtenues en 2025 sur votre compte pourraient expirer vers le 31 mars 2026. Veuillez les utiliser avant leur expiration afin d'éviter toute perte. Mises à jour principales : + Ajout de l'arrêt automatique une fois le téléchargement terminé : activez l'option « Arrêter » dans la fenêtre contextuelle de lancement du téléchargement ou dans les paramètres situés dans le coin supérieur droit du panneau de téléchargement pour éteindre automatiquement l'appareil une fois le téléchargement terminé. - Correction d'un problème où le titre de la barre latérale ne s'affichait pas après le chargement. * Restauration de la fonction d'ouverture directe des fichiers une fois le téléchargement terminé : cochez « Ouvrir directement » dans la fenêtre contextuelle de démarrage du téléchargement et le fichier s'ouvrira automatiquement après le téléchargement sans passer par la liste des téléchargements. - Correction d'un problème où certains téléchargements ne pouvaient pas être menés à terme à 100 %. - Correction d'un problème où la suppression de fichiers locaux n'apparaissait pas dans le gestionnaire de téléchargement. - Correction d'un problème de renommage dans la fenêtre de téléchargement lorsqu'un fichier local portant le même nom existait déjà. - Correction d'un problème lié à des notifications de téléchargement anormales. - Correction d'un problème où l'état de la tâche de téléchargement était incorrect après la fin du téléchargement d'une vidéo. - Correction d'un problème où les onglets fixes pouvaient être fermés dans le panneau des onglets de recherche. - Correction de plantages connus.

-

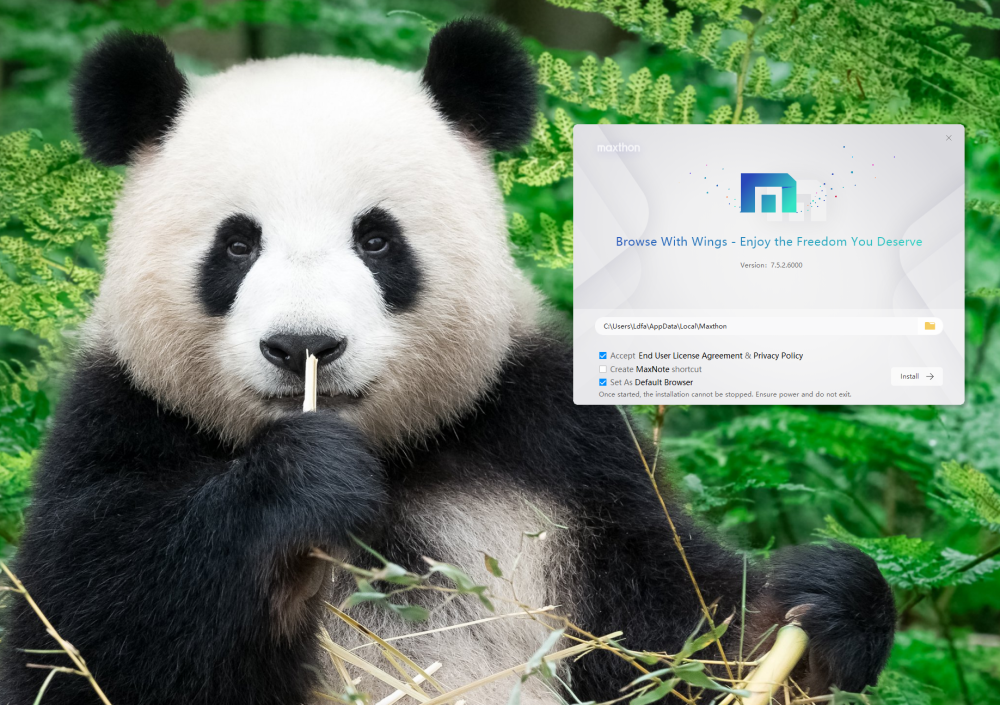

Maxthon 7.5.2.6200 Bêta pour Windows est sorti aujourd'hui, il apporte son lot de nouvelles fonctionnalités, d'améliorations et de corrections de bugs. Téléchargement : https://github.com/maxthon/Maxthon/releases/ Les changements en français sont là. Vous pouvez également vous abonner au groupe Telegram NBdomain & MX6 pour faire remonter vos demandes d'améliorations et bugs rencontrés. Source : https://forum.maxthon.com/d/3974-maxthon-7526200-beta-release

-

Et un autre petit projet pour mon CYD : https://korben.info/il-transforme-une-carte-a-15-euros-en-station-meteo-sous-windows-95.html

-

-

-

-

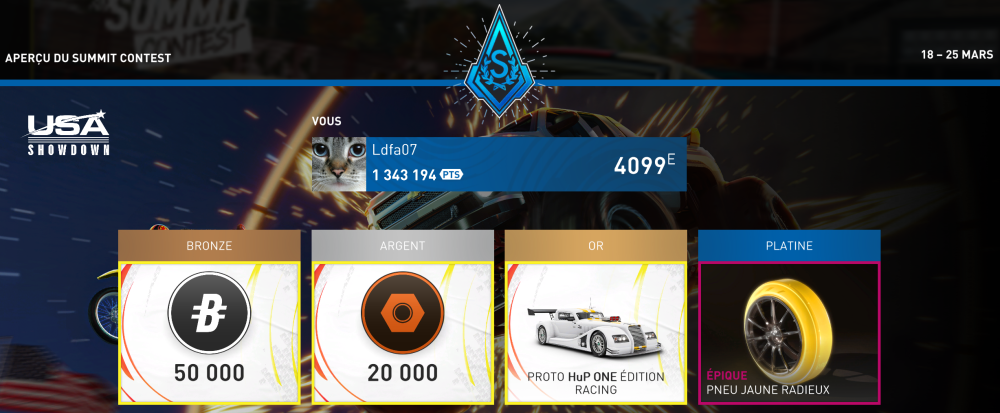

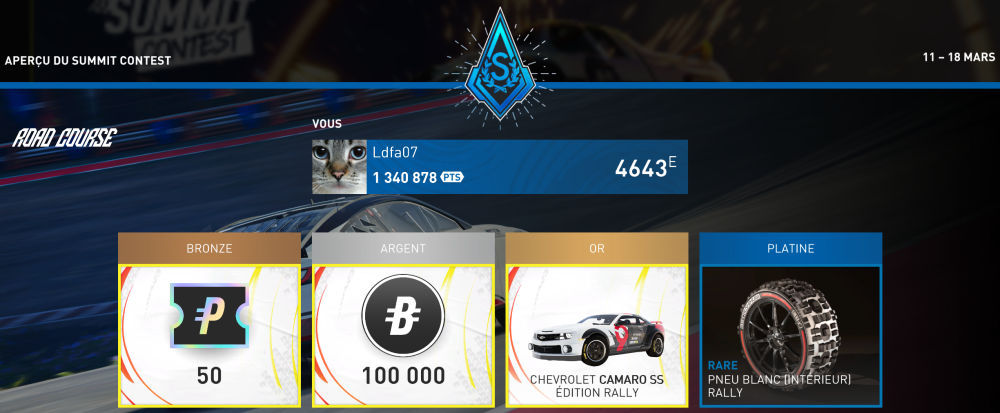

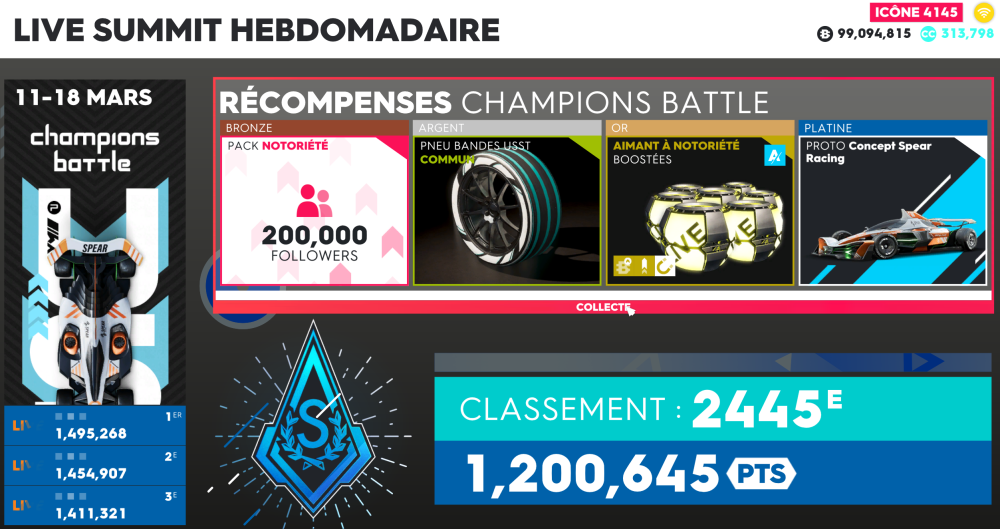

Belle promo en ce moment chez Ubisoft sur The Crew Motorfest à 5,60€ pour la version standard : https://www.dealabs.com/bons-plans/selection-de-jeux-pc-en-promotion-ex-the-crew-motorfest-a-56eur-star-wars-outlaws-a-168eur-dematerialise-3297106 Je me suis payé la Saison 3 pour 16,79€ au lieu de 29,99€, ça valait le coup d'attendre un peu.

-

Pour rappel, voici comment dépenser les pièces d'or obtenues en 2025 : Si Maxthon ne met pas une autre solution en place, je vais atteindre assez rapidement les limites de ma petite existance :

-

Proxmox Proxmox VE Helper-Scripts : une collection de scripts prêts à l'emploi - IT-Connect

Ldfa a répondu à un(e) sujet de Ldfa dans Mon Wallabag

Ce site est une véritable mine d'or pour installer facilement tous types de conteneurs/VM sur Proxmox. -

IT-Connect Publié le 16 mars 2026 Par Florian BURNEL it-connect.fr Environ 8 minutes de lecture Proxmox VE Helper-Scripts : derrière ce nom se cache une collection de plus de 500 scripts Bash prêts à l'emploi. Ils sont conçus pour faciliter l'administration de Proxmox VE et le déploiement d'applications par l'intermédiaire de conteneurs LXC ou de machines virtuelles. L'utilisation de ces scripts facilite l'automatisation des tâches, en particulier pour le déploiement rapide d'applications. C'est particulièrement pratique pour déployer un environnement de développement rapidement : une seule commande suffit à déployer une application. En effet, chaque service dispose de son propre script Bash conçu pour Proxmox et qui permet de déployer une instance avec un service opérationnel. Si vous désirez en savoir plus, regardez la vidéo ci-dessous ou poursuivez la lecture de cet article. A lire également : Proxmox VE : bien débuter avec les conteneurs LXC Proxmox VE : exécuter des images OCI (Docker) nativement dans LXC Proxmox VE : comment créer des conteneurs Docker ? Que sont les Proxmox VE Helper-Scripts ? Les Proxmox VE Helper-Scripts constituent une collection de scripts shell (développés en Bash) conçus pour interagir directement avec l'interface en ligne de commande de Proxmox. Ces scripts ont pour vocation principale d'automatiser le cycle de vie des conteneurs LXC (Linux Containers) et des machines virtuelles (VM). Au lieu de télécharger manuellement un template de distribution Linux, de créer le conteneur, de configurer les interfaces réseaux, d'allouer l'espace de stockage, puis de mettre à jour le système avant d'installer un applicatif, le script se charge de l'ensemble de ces opérations. Le concept plaît : plus de 500 scripts sont disponibles et ils ont été utilisés plus de 2 millions de fois. Ces scripts, référencés sur le site community-scripts.org et référencés sur GitHub, sont organisés par catégories : Docker, réseau, authentification, sécurité, sauvegarde, et j'en passe. Ce sont les sources officielles liées à ce projet : attention à ne pas tomber sur une autre page lors de vos recherches. En parcourant ces catégories, vous pourrez visualiser des scripts pour : Configurer Proxmox VE et en assurer la maintenance, Déployer une application dans un conteneur LXC, Déployer un système d'exploitation (OPNsense, par exemple) ou une application dans une machine virtuelle. Utilisation d'un Helper-Script Quand vous cliquez sur une application ou un service, vous aurez accès à la description, à la ligne de commande permettant de lancer l'installation ou la tâche, et à des informations supplémentaires pour en savoir plus. À chaque fois, je vous encourage à lire la section "NOTES", elle donne des précisions sur le Helper-Script associé et les éventuelles subtilités. De plus, la section de droite nommée "DETAILS" est précieuse puisqu'elle indique : La version déployée du service, Un lien vers le site web de la solution et vers sa documentation, Le fichier de configuration et le numéro de port (utile pour l'accès à l'interface web), Le code source du script d'installation (avec aussi un lien vers la page sur GitHub), Ce dernier point est important : avant d'exécuter un script provenant d'Internet sur votre serveur Proxmox VE, prenez le temps de le consulter ! Même si c'est une source de confiance, soyez vigilant : c'est une règle d'or. Pour lancer l'opération, c'est simple : vous copiez-collez la ligne de code et vous l'exécutez sur votre serveur Proxmox, depuis le Terminal (local ou SSH). Néanmoins, en basculant sur le mode "Advanced", vous pouvez ajuster la configuration du conteneur qui sera créé : CPU, RAM et disque. Par défaut, chaque service a une configuration prédéfinie, mais vous gardez la main. Dans ce cas, des variables avec les nouvelles valeurs seront ajoutées de façon dynamique à la ligne de commande que vous devez exécuter. Par exemple : var_ram="8192" var_disk="32" bash -c "$(curl -fsSL https://raw.githubusercontent.com/community-scripts/ProxmoxVE/main/ct/immich.sh)" Les scripts s'exécutent via une commande de type bash -c associée à l'utilitaire curl chargé de récupérer le script Bash depuis GitHub (ou Gitea). Ainsi, cette commande récupère le code source brut et l'exécute. Un menu interactif s'affiche alors directement dans le terminal afin de vous guider pendant l'installation (sauf si vous passez par le "Generator") L'assistant propose plusieurs modes d'installation : Default Install : ce mode applique des paramètres prédéfinis. Il alloue la RAM, le nombre de cœurs CPU et l'espace disque jugés adéquats par le développeur du script. L'adresse IP sera obtenue via DHCP. Ce mode convient pour des tests rapides. Advanced Install : il est recommandé de choisir ce mode pour personnaliser le déploiement. En effet, il permet de définir manuellement l'ensemble de la configuration : L'ID du conteneur (CT ID). Le type de conteneur (Privilégié ou Non-privilégié). Le mot de passe root de l'instance. Les ressources matérielles allouées (Cœurs CPU, RAM, Swap). Le volume de stockage à utiliser. L'adresse IP statique, le masque de sous-réseau et la passerelle par défaut. Le VLAN tag, utile si votre réseau est segmenté. Etc... User Defaults : il permet d'utiliser les valeurs par défaut définies par vous, l'utilisateur. Quand vous installez une application une première fois, vos choix sont stockés dans un fichier et ce dernier peut être réutilisé par la suite (vous conservez ainsi vos préférences). Une fois les paramètres validés, le script télécharge l'image du système d'exploitation, configure l'instance, la démarre, puis exécute un script de post-installation à l'intérieur du conteneur pour installer l'application (ici, Docker). L'installation s'effectue en totale autonomie et le retour console permet de suivre la progression des opérations. A la fin, quand une application est installée, vous aurez toujours l'URL d'accès, comme ici : http://192.168.110.13:2283. Il suffit d'accéder à cette URL pour accéder à l'application ! Voyez par vous-même. Le générateur de scripts personnalisés Depuis le site officiel de ce projet, vous pouvez accéder à un générateur de scripts pour automatiser l'installation selon une approche sans surveillance. Il vous suffit de cliquer sur "Generator" dans le menu. Vous choisissez le script à personnaliser, à savoir celui de l'application à déployer. Vous définissez ensuite les ressources à attribuer à ce conteneur LXC ou à cette VM. Puis, vous pouvez personnaliser tout le reste : ID de conteneur, nom d'hôte, mot de passe, pont réseau sur lequel se connecter, ID de VLAN ou encore les options comme le SSH, le GPU Passthrough et le Nesting. Une fois la configuration effectuée via cette interface en ligne, vous obtenez une commande prête à l'emploi. Cette commande contient des variables préconfigurées qui sont le reflet des choix effectués via le formulaire du générateur. Voici un exemple : mode=generated var_ctid="500" var_hostname="immich-itconnect" var_vlan="10" var_tags="media" var_gpu="yes" bash -c "$(curl -fsSL https://raw.githubusercontent.com/community-scripts/ProxmoxVE/main/ct/immich.sh)" Si vous lancez la commande obtenue, l'installation sera lancée et vous n'aurez rien à faire ! Tout est automatique (vous noterez la présence de mode=generated). Gérer la maintenance et les opérations d'administration Les Helper-Scripts ne se limitent pas à la création d'instances. De nombreux scripts participent à la maintenance de l'hyperviseur et des conteneurs. Script pour la post-installation de Proxmox VE Il existe également des scripts destinés à configurer l'hôte Proxmox lui-même, en particulier après une nouvelle installation. Ces outils appelés "Post-Install Scripts" automatisent des tâches d'administration courantes et s'adressent à Proxmox VE, mais aussi Proxmox Mail Gateway et Proxmox Backup Server (PBS). Dans le cas de Proxmox VE, le script nommé PVE Post Install effectue un ensemble d'actions : La désactivation du message d'avertissement lié à l'absence de souscription commerciale (Enterprise Repository). L'ajout des dépôts communautaires (No-Subscription Repository) pour permettre les mises à jour du système via apt. La mise à jour du nœud Proxmox VE (paquets) La désactivation des services inutiles si vous n'envisagez pas d'être en mode cluster (réversible) Etc... À chaque fois, vous avez le choix : vous gardez le contrôle. Le script n'impose rien. Script de mise à jour des conteneurs LXC Certains applicatifs hébergés en LXC ne disposent pas de mécanisme de mise à jour interne simple. Des scripts spécifiques permettent d'automatiser ce processus. En exécutant un script de mise à jour (souvent nommé update script), le système se connecte au conteneur, arrête les services concernés, télécharge la dernière version de l'application depuis son dépôt officiel, l'installe et redémarre le service, le tout en préservant les données de configuration de l'utilisateur. Il y a en réalité deux catégories de scripts de mises à jour : Les scripts pour mettre à jour l'OS dans les conteneurs LXC (ils ne touchent pas à l'application). Les scripts pour mettre à jour l'application en elle-même. Par exemple, le script PVE LXC Updater sert justement à mettre à jour le système d'exploitation. De son côté, le script PVE LXC Apps Updater met à jour les applications. Pour cela, il surveille les tags sur les conteneurs LXC afin de cibler les conteneurs avec le tag community-script ou proxmox-helper-scripts (par défaut, car c'est personnalisable). Script de sauvegarde Proxmox VE Un dernier cas d'usage et script que l'on peut citer : PVE Host Backup. Ce script permet aux utilisateurs de sauvegarder des données, tout en offrant la possibilité de sélectionner les fichiers et répertoires spécifiques à sauvegarder. Cette flexibilité lui permet une compatibilité large, qui va au-delà de Proxmox (merci Bash). Dans le contexte de Proxmox VE, ce script facilite la sauvegarde des fichiers systèmes. Conclusion L'utilisation des Proxmox VE Helper-Scripts représente une méthode efficace pour rationaliser les déploiements de services en limitant les opérations manuelles et répétitives. Si vous aimez tester différentes applications, cela représentera un gain de temps ! Vous pouvez aussi vous inspirer de ces scripts pour coder vos propres scripts d'installation. Veillez toujours à privilégier l'utilisation de conteneurs non privilégiés et à réviser le code source du script avant l'exécution. Ceci est particulièrement vrai pour les applications où il y a peu d'installations, bien que les Helper-Scripts soient largement utilisés et révisés par la communauté. Ingénieur système et réseau, cofondateur d'IT-Connect et Microsoft MVP "Cloud and Datacenter Management". Je souhaite partager mon expérience et mes découvertes au travers de mes articles. Généraliste avec une attirance particulière pour les solutions Microsoft et le scripting. Bonne lecture. Afficher l’article complet

-

Démarchage WinCalls - L'appli qui raccroche au nez des démarcheurs - Korben

Ldfa a posté un sujet dans Mon Wallabag

Korben Publié le 16 mars 2026 Par Korben, Manuel Dorne korben.info Environ 2 minutes de lecture Le démarchage téléphonique, on n'en peut plus !! Y'a bien Bloctel qui devait régler le problème... sauf que notre téléphone continue de sonner 3 fois par jour avec des histoires de CPF ou de panneaux solaires. Pas ouf quoi... Du coup, un enquêteur en fraude connu du web a décidé de créer sa propre appli Android pour raccrocher automatiquement au nez de ces FDP de spammeurs. WinCalls , c'est le nom de la bête. Vous l'installez sur votre smartphone, vous activez la protection, et tadaaa, l'appli détecte les coups de fil de démarchage et raccroche toute seule avant même que votre téléphone ait le temps de sonner. Y'a même pas de notif, c'est clean ! Le spammeur parle dans le vide et vous, vous continuez votre vie peinard. Le truc cool, c'est le bonhomme derrière. Centho , c'est un enquêteur spécialisé dans la fraude, qui traque les arnaqueurs au quotidien parce que c'est littéralement son métier, du coup forcément, il sait comment les démarcheurs fonctionnent et comment leur couper le sifflet. Bon, vous allez me dire qu'Android a déjà un filtre anti-spam intégré. C'est vrai. Et sur les Pixel, il peut même bloquer les démarcheurs automatiquement mais sur la plupart des autres smartphones, il se contente juste de vous signaler l'appel et c'est ensuite à vous de décider si vous décrochez ou pas. Donc ça reste relou. La différence avec WinCalls, c'est donc la méthode car l'appli se base entre autres sur les préfixes de numéros réservés au démarchage par l'ARCEP (genre les 0162, 0163...) pour identifier les appels commerciaux et raccrocher directement. Tout se fait donc en local sur votre téléphone. Contrairement à d'autres applis qui aspirent votre carnet d'adresses pour alimenter leur base (coucou Truecaller), ici zéro données transmises à l'extérieur. C'est propre ! Merci Centho ! Après c'est Android uniquement donc les possesseurs d'iPhone devront se débrouiller autrement (le filtre intégré d'iOS fait à vrai dire un boulot correct, mais c'est pas le même niveau... Moi j'utilise Begone et l'appli Orange Téléphone sous iOS). Ah et surtout c'est totalement gratuit. Le projet fonctionne uniquement grâce aux dons des utilisateurs qui en ont marre de se faire harceler et y'a même une communauté Discord pour remonter des faux positifs ou poser vos questions, bref c'est bien fichu. Si la sécurité de votre téléphone Android vous préoccupe de manière plus globale, c'est un bon complément. Et pour ceux qui se demandent comment se débarrasser définitivement des appels indésirables, la combo c'est de s'inscrire sur Bloctel (ça filtre les démarcheurs légaux... les 3 qui restent) et d'utiliser WinCalls qui agit à un niveau différent en bloquant via les préfixes ARCEP. Les deux se complètent plutôt bien. C'est gratuit et c'est par là . Merci à Gotcha57 pour l'info ! Afficher l’article complet -

Win Traduction française de Mx7 pour Windows

Ldfa a répondu à un(e) sujet de Ldfa dans Traductions françaises de Maxthon sur Crowdin

Traduction approuvée. fr.ini -

Win Traduction française de Mx7 pour Windows

Ldfa a répondu à un(e) sujet de Ldfa dans Traductions françaises de Maxthon sur Crowdin

Pushray, c'est le service de partage de fichier de Maxthon, j'en ai parlé ici : -

Win Traduction française de Mx7 pour Windows

Ldfa a répondu à un(e) sujet de Ldfa dans Traductions françaises de Maxthon sur Crowdin

There are new strings to translate in the Maxthon pour Windows project. You were a project participant previously so your help will be appreciated a lot. 59 new strings for translation (180 words). -

Rappel concernant l'expiration des pièces d'or : Important : Certaines pièces d'or obtenues en 2025 sur votre compte pourraient expirer vers le 31 mars 2026. Veuillez les utiliser avant leur expiration afin d'éviter toute perte. Mises à jour principales : + Ajout d'un système intelligent de téléchargement automatique de vidéos multi-stratégies, qui bascule automatiquement entre les différents chemins de téléchargement pour améliorer la vitesse et le taux de réussite. + Ajout du lecteur vidéo Maxthon, permettant la lecture directe des vidéos téléchargées dans le navigateur. + Ajout des notifications de téléchargement Maxthon, gérables dans Paramètres > Téléchargement, permettant aux utilisateurs de désactiver les notifications ou les effets sonores. Aller dans Paramètres Autres : * Optimisation du panneau de gestion des téléchargements. * Optimisation de la nouvelle interaction de téléchargement de vidéos. - Suppression du module de fonction « Ajouter les enregistrements visités aux moteurs de recherche » de la page des paramètres. - Correction d'un problème où certains téléchargements n'avaient aucune tâche après confirmation. - Correction d'un problème où les champs de saisie dans la nouvelle fenêtre des signets/favoris s'étendaient au-delà du côté droit de la zone de la fenêtre. - Correction de plantages connus.

-

Maxthon 7.5.2.6000 Bêta pour Windows est sorti aujourd'hui, il apporte son lot de nouvelles fonctionnalités, d'améliorations et de corrections de bugs. Téléchargement : https://github.com/maxthon/Maxthon/releases/ Les changements en français sont là. Vous pouvez également vous abonner au groupe Telegram NBdomain & MX6 pour faire remonter vos demandes d'améliorations et bugs rencontrés. Source : https://forum.maxthon.com/d/3907-maxthon-pc-7526000-beta

-

Impressionnant, on s'y croirait !!!

-

C'est vrai, mais je n'ai pas connu ce qui se passait si on n'arrivait pas à s'extraire...